Ferret-UI 2是一款由苹果公司推出的多模态大型语言模型,旨在提升移动用户界面的理解与交互能力。该产品能够识别和解析各种移动设备上的用户界面元素,执行复杂的用户指令,并实时监测用户在屏幕上的操作,随时准备提供帮助并完成任务。相较于前一版本,Ferret-UI 2在高分辨率图像编码和数据训练方法上进行了显著改进,增强了UI元素的识别精度和交互能力,使用户与智能设备的互动更加自然和高效。

Ferret-UI 2是什么

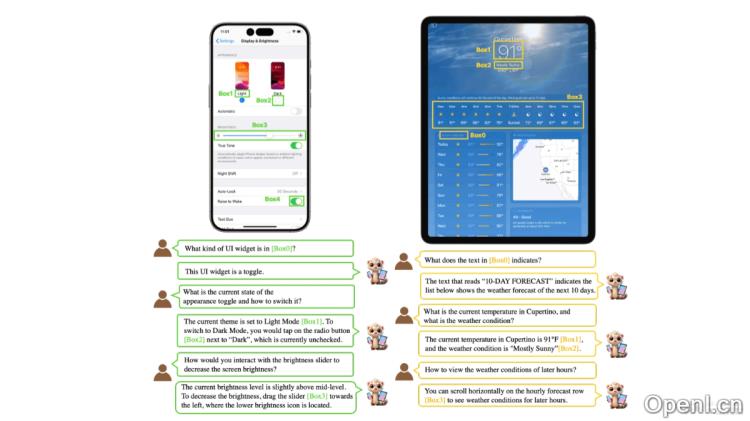

Ferret-UI 2是一款由苹果公司开发的多模态大型语言模型,专注于理解和交互移动用户界面。它能够解析各种移动设备的屏幕UI元素,执行复杂的用户指令,并实时观察用户的操作。Ferret-UI 2在早期版本的基础上实现了重大的技术革新,通过高分辨率图像编码及先进的数据训练方法,显著提升了UI元素的识别精度和交互能力,使得用户能够以更自然的方式与智能设备进行交互。

Ferret-UI 2的主要功能

- 多平台兼容性:Ferret-UI 2可在包括iPhone、Android、iPad、网页和Apple TV等多种平台上处理用户界面。

- 高分辨率图像识别:利用自适应缩放技术,Ferret-UI 2在保持原始UI图像分辨率的同时,提供更精确的视觉元素识别。

- 复杂任务的训练数据生成:依托于GPT-4o和set-of-mark视觉提示,Ferret-UI 2生成用于复杂任务的训练数据,增强模型对UI元素空间关系的理解。

- 以用户为中心的交互:Ferret-UI 2能够理解并执行用户导向的交互任务,如确认提交、点击按钮等,超越了简单的机械点击。

- 跨平台适应能力:Ferret-UI 2展现出强大的跨平台迁移能力,能在不同平台之间灵活适应。

Ferret-UI 2的技术原理

- 多模态大型语言模型(MLLM):结合视觉感知与语言处理的强大能力,理解并生成复杂的UI交互。

- 自适应N网格机制:通过算法确定最优网格大小,以最小的分辨率失真编码UI截图的各个部分。

- 动态高分辨率图像编码:利用CLIP图像编码器提取全局和局部特征,并将这些特征传递至大型语言模型(LLM)。

- 视觉采样器:依据用户指令识别并选择相关UI区域,输出对UI元素的感知或交互描述。

- set-of-mark(SoM)视觉提示:在生成训练数据时,利用SoM提示增强模型对UI元素空间关系的理解,尤其在多轮感知与交互问答任务中。

- 端到端训练:模型通过端到端的训练过程学习原始数据注释,生成高质量的训练数据并优化模型性能。

Ferret-UI 2的项目地址

- arXiv技术论文:https://arxiv.org/pdf/2410.18967

Ferret-UI 2的应用场景

- 智能手机和平板电脑:Ferret-UI 2能够理解并执行用户在iOS和Android设备上的各种指令,如导航应用、发送消息、设置提醒等。

- 网络浏览:在网页浏览中,帮助用户更有效地与网页元素进行交互,例如点击按钮、填写表单、导航链接等。

- 智能电视:对于Apple TV等智能电视平台,提供语音控制及其他交互方式,提升用户体验。

- 多任务环境:在需要同时处理多个应用程序或窗口的场景中,帮助用户更加高效地管理和切换不同的任务。

- 辅助技术:可集成于辅助技术中,帮助残障人士通过语音命令或其他输入方式与设备进行交互。

常见问题

- Ferret-UI 2是否支持所有移动设备? 是的,Ferret-UI 2支持多种移动设备,包括iPhone、Android及平板电脑等。

- 如何确保Ferret-UI 2的隐私安全? 苹果公司致力于用户隐私,Ferret-UI 2在设计时充分考虑了数据安全和用户隐私保护。

- Ferret-UI 2的学习能力如何? 通过端到端的训练,Ferret-UI 2持续学习并优化其对UI交互的理解和执行能力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号