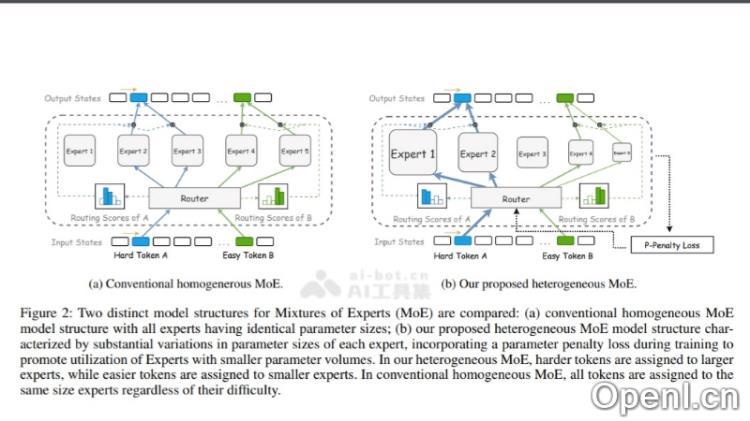

HMoE(混合异构专家模型)是腾讯混元团队研发的一种创新神经网络架构,旨在提升大型语言模型的性能和计算效率。通过引入不同规模的专家来处理具有不同复杂性的输入数据,HMoE增强了模型的专业化能力。该模型采用了新的训练目标和策略,例如P-Penalty Loss,鼓励频繁激活较小的专家,从而提高参数的利用率和计算效率。实验证明,HMoE在多个预训练评估基准上展现了优异的性能,为大型模型的研究指明了新的方向。

HMoE是什么

HMoE(混合异构专家模型)是腾讯混元团队提出的一种新型神经网络架构,旨在提升大型语言模型的性能和计算效率。通过引入不同尺寸的专家来处理不同复杂性的输入数据,HMoE增强了模型的专业化程度。HMoE采用新的训练目标和策略,如P-Penalty Loss,鼓励频繁激活较小的专家,以提高参数的利用率和计算效率。实验证明,HMoE在多个预训练评估基准上表现卓越,为大模型研究提供了新方向。

主要功能

- 异构专家设计:HMoE模型中的专家具有不同规模,能够根据输入数据的复杂性分配不同能力的专家进行处理,从而提升模型的专业化和灵活性。

- 计算效率优化:通过优先激活较小的专家处理简单任务,HMoE在保持高效计算的同时,将计算资源集中于更复杂的任务。

- 参数利用效率:HMoE通过P-Penalty Loss等训练策略,优化了参数的分配和激活,减少了对大型专家的依赖,提升了整体的参数使用效率。

- 动态路由策略:结合Top-P和Top-K路由策略,HMoE能够根据每个token的重要性动态激活相应数量的专家,实现更精细的模型控制。

- 性能提升:在多个预训练评估基准上,HMoE展现出超越传统同质MoE模型的性能,证明其在处理复杂语言任务方面的有效性。

产品官网

应用场景

- 自然语言处理(NLP):HMoE可应用于机器翻译、文本摘要、情感分析、文本分类、问答系统等NLP任务,利用异构专家处理不同语言特性的能力。

- 内容推荐系统:在推荐系统中,HMoE能够分析用户行为和偏好,提供个性化的内容推荐。

- 语音识别:HMoE适用于语音识别技术,处理不同说话者的特征以及语音中的复杂信息。

- 图像和视频分析:尽管HMoE主要设计用于语言模型,其异构专家的概念也可扩展到图像和视频分析领域,以处理视觉数据的不同方面。

- 多模态学习:在处理结合文本、图像和声音等多种数据类型的任务时,HMoE能有效分配专家以处理不同模态的数据。

常见问题

- HMoE如何提升计算效率?通过引入异构专家和优化激活策略,HMoE在处理简单任务时激活较小的专家,从而节省计算资源。

- HMoE适合哪些应用场景?HMoE广泛适用于自然语言处理、内容推荐、语音识别等多种任务。

- 什么是P-Penalty Loss?P-Penalty Loss是HMoE的一种训练策略,旨在优化专家的激活平衡,鼓励更多小型专家的使用。

- HMoE与传统MoE模型有什么区别?HMoE通过异构专家结构和动态激活机制,显著提升了在复杂任务上的表现,超越了传统同质MoE模型。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号