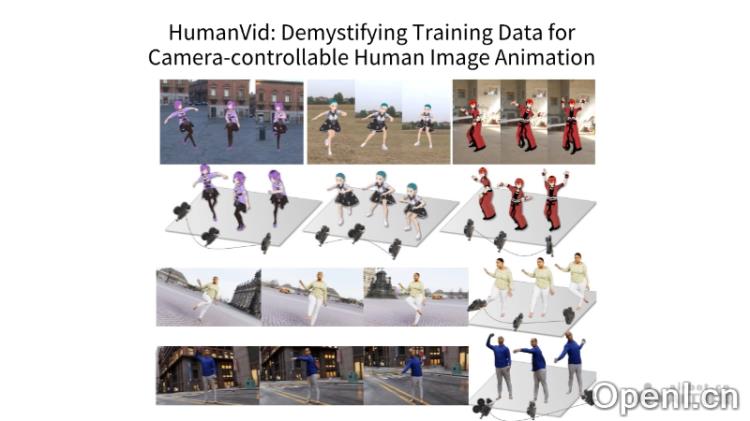

HumanVid是一款由香港中文大学与上海人工智能实验室联合研发的高质量数据集,专为人类图像动画训练而设计。该数据集结合了真实世界的视频与合成数据,经过精心的规则筛选和高质量注释,力求提升视频生成的控制性与稳定性。通过基线模型CamAnimate的验证,HumanVid在控制人物姿势与摄像机运动方面取得了显著进展,计划于2024年9月底公开代码与数据集。

HumanVid是什么

HumanVid是一个旨在推动人类图像动画研究的高质量数据集,由香港中文大学和上海人工智能实验室共同开发。该数据集通过整合现实世界的视频和合成数据,采用严格的筛选标准确保视频质量,并运用2D姿势估计和SLAM技术进行详细注释。HumanVid旨在提升视频生成的可控性与稳定性,并通过基线模型CamAnimate证明其在姿势控制与摄像机运动方面的有效性。该项目预计在2024年9月底发布相应的代码和数据集。

HumanVid的主要功能

- 高质量数据集成:融合现实世界与合成数据,确保数据集的多样性与丰富性。

- 版权无忧:所有视频与3D角色资产均为无版权素材,方便研究与应用。

- 严格筛选机制:通过规则筛选确保数据集内视频的高标准。

- 精准注释技术:应用2D姿势估计和SLAM技术,对视频中的人体和摄像机运动进行精确标注。

HumanVid的技术原理

- 数据集构建:HumanVid通过从互联网上收集大量无版权的真实视频,并结合合成数据,旨在构建一个高质量的数据集。所有视频经过严格的筛选流程,确保数据的高标准。

- 注释方法:运用2D姿势估计技术对视频中的人体动作进行标注,同时采用SLAM(同时定位与建图)技术注释摄像机的移动轨迹。

- 合成数据生成:为了丰富数据集,HumanVid收集了无版权的3D角色资产,并引入基于规则的摄像机轨迹生成方法,以模拟多样化的摄像机运动。

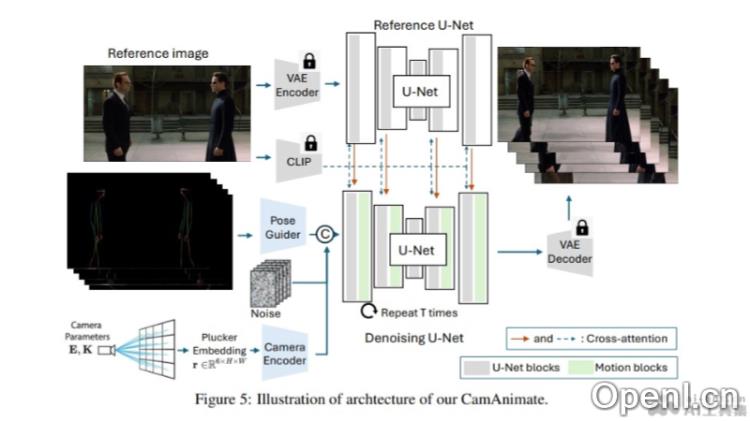

- 模型训练:HumanVid建立了一个基线模型CamAnimate,考虑了人体及摄像机的运动作为条件,经过在HumanVid数据集上的训练,能够生成可控的人物姿势与摄像机运动的视频。

HumanVid的项目地址

- GitHub仓库:https://github.com/zhenzhiwang/HumanVid

- arXiv技术论文:https://arxiv.org/pdf/2407.17438

HumanVid的应用场景

- 视频制作:为电影、电视及其他视频内容创作提供高质量的动画生成,支持导演与制片人通过控制人物姿态与镜头运动,打造更生动的场景。

- 游戏开发:在电子游戏中,HumanVid能够生成真实感极强的NPC(非玩家角色)动画,增强游戏的沉浸感与互动性。

- 虚拟现实与增强现实:在VR和AR应用中,HumanVid可生成与用户互动的虚拟角色,提供更加自然流畅的体验。

- 教育与培训:HumanVid能够制作教学视频,模拟人物动作与场景,帮助学生更好地理解复杂概念。

常见问题

- HumanVid的数据集如何获取?:HumanVid计划于2024年9月底公开代码及数据集,届时可在其GitHub页面找到相关信息。

- HumanVid支持哪些平台?:HumanVid的数据集可在多种平台上使用,主要面向研究人员和开发者。

- 如何参与HumanVid项目?:您可以通过访问其GitHub页面,关注项目进展并参与讨论。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号