MM1.5是苹果公司推出的一款先进的多模态大型语言模型,旨在提升对文本丰富图像的理解、视觉指代和定位能力,以及多图像推理的水平。该模型通过数据驱动的训练方法,实现了从10亿到300亿参数规模的高效性能,包括密集型和混合专家(MoE)变体,突出了小规模模型通过精细数据策划和训练策略所能达到的卓越表现。此外,MM1.5还推出了针对视频理解和移动用户界面分析的专门版本MM1.5-Video和MM1.5-UI,基于实证研究提供了训练过程和决策的深入见解,为多模态人工智能技术的未来发展指明了方向。

MM1.5是什么

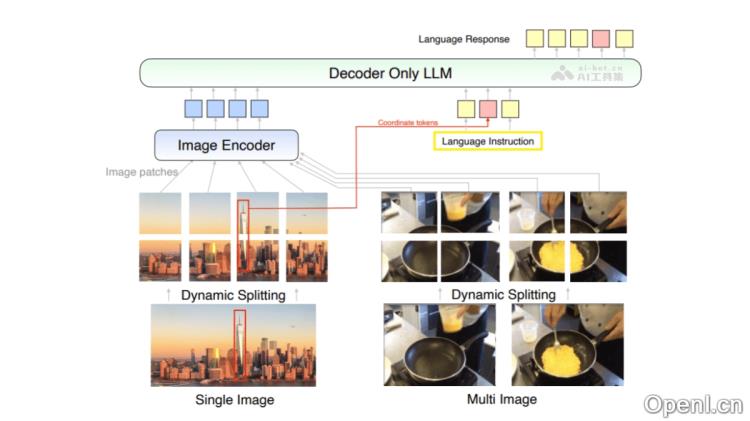

MM1.5是苹果公司推出的多模态大型语言模型,旨在提升文本丰富图像的理解、视觉指代和定位能力,以及多图像推理的能力。该模型采用数据驱动的训练策略,通过大规模的预训练和高分辨率OCR数据的持续优化,结合视觉指令微调,达到1B到30B参数规模的高性能。MM1.5具有密集型和MoE变体,展示了小规模模型通过精细的数据策划和训练策略所能获得的强大性能。针对视频理解和移动用户界面的分析,MM1.5还推出了专门的变体MM1.5-Video和MM1.5-UI,为多模态AI技术的未来发展提供了重要的指导。

MM1.5的主要功能

- 文本丰富的图像理解:MM1.5能够识别图像中的文本内容,并理解文本与图像之间的关系。

- 视觉指代和定位:模型能够识别图像中特定的对象,并理解文本中对这些对象的引用,例如“那个红色的球”。

- 多图像推理:MM1.5能够分析多幅图像,理解它们之间的联系并进行逻辑推理。

- 视频理解:通过MM1.5-Video变体,模型能够理解视频中的内容,包括动作、事件及其时间顺序。

- 移动UI理解:MM1.5-UI变体专注于移动应用界面的理解,能够识别和操作界面元素。

MM1.5的技术原理

- 深度学习与自然语言处理:结合深度学习视觉模型和自然语言处理技术,使模型能够理解并生成与图像内容相关的文本。

- 坐标token与视觉注意力机制:使用坐标token来定位图像中的对象,基于视觉注意力机制聚焦于图像的特定区域。

- 图像分割与多模态融合:将图像分割成多个部分,并与文本信息进行融合,以支持多图像的推理能力。

- 视频帧采样与时序分析:对视频帧进行采样,分析帧之间的时序关系,从而理解视频内容。

- 界面元素识别:利用图像识别技术识别移动界面上的元素,如按钮和图标。

MM1.5的项目地址

- arXiv技术论文:https://arxiv.org/pdf/2409.20566v1

MM1.5的应用场景

- 图像与视频理解:MM1.5可用于分析图像和视频内容,应用于图像标注、视频内容分析和安防监控等领域。

- 视觉搜索:在电子商务或数字图书馆中,MM1.5帮助用户基于描述或查询图像搜索特定的产品或文档。

- 辅助驾驶与自动驾驶:在汽车行业,MM1.5用于理解和分析道路情况,辅助驾驶决策。

- 智能助手:在智能手机和智能家居设备中,MM1.5提供更自然、直观的交互方式,理解用户的语音或文本指令。

- 教育与培训:作为教育工具,MM1.5帮助学生理解复杂概念,提供个性化学习体验。

常见问题

- MM1.5的适用领域是什么? MM1.5广泛应用于图像与视频理解、视觉搜索、智能助手和教育培训等多个领域。

- 如何访问MM1.5的技术文档? 详细的技术资料可以通过访问arXiv技术论文获取。

- MM1.5的性能如何? MM1.5在多个多模态任务上展现出卓越的性能,能够处理大量参数并实现高效的推理能力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号