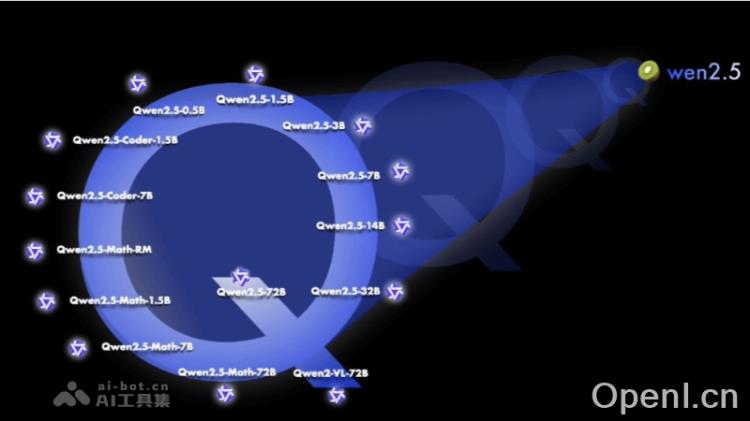

Qwen2.5 是阿里通义千问团队推出的最新开源AI大模型,标志着人工智能技术的一次重要进展。该模型提供多种参数规模,涵盖 0.5B、1.5B、3B、7B、14B、32B 和 72B,预训练过程中利用了多达 18 万亿个 tokens 的庞大数据集,显著增强了自然语言理解、文本生成、编程与数学能力。

Qwen2.5是什么

Qwen2.5 是阿里通义千问团队最新开源的顶尖AI大模型,具备多种参数规模的选项,包括 0.5B、1.5B、3B、7B、14B、32B 和 72B。该模型在预训练时采用了最新的大规模数据集,涵盖了多达 18 万亿个 tokens,使得 Qwen2.5 在自然语言理解、文本生成、编程能力和数学能力等方面都有了显著的提升。Qwen2.5 不仅支持长文本处理,能够生成超过 8K tokens 的内容,还增强了对系统提示的灵活适应性,提升了角色扮演和聊天机器人的背景设定能力。此外,Qwen2.5 支持多达 29 种语言,包括中文、英文、法文、西班牙文、葡萄牙文和德文等。Qwen2.5-Coder 和 Qwen2.5-Math 是专门针对编程和数学问题优化的模型,在相关领域展现了卓越的性能。

主要功能

- 多样化模型规模:Qwen2.5 提供从 0.5B 到 72B 不同参数规模的模型,以满足各种应用需求。

- 扩展的预训练数据集:Qwen2.5 的预训练数据集从 7T tokens 扩展到 18T tokens,显著提升了模型的知识储备。

- 增强的多语言能力:Qwen2.5 支持超过 29 种语言,包括中文和英文,确保了广泛的多语言支持。

- 提升的编程和数学能力:Qwen2.5-Coder 和 Qwen2.5-Math 针对编程和数学问题进行了专门优化,提供了更专业的解决方案。

- 长文本处理能力:Qwen2.5 支持高达 128K tokens 的上下文长度,能够生成最长 8K tokens 的内容,增强了对长文本的处理能力。

- 结构化数据处理:该模型在理解和生成结构化数据(如表格)方面有显著改善,尤其在 JSON 输出方面表现突出。

- 系统提示适应性:Qwen2.5 对各种系统提示具有更强的适应性,提升了角色扮演和聊天机器人的条件设置能力。

产品官网

应用场景

- 聊天机器人和虚拟助手:Qwen2.5 可以作为对话系统的核心,提供自然语言理解和生成,实现用户的交互需求。

- 内容创作和编辑:能够自动生成文章、故事、诗歌等文本内容,辅助用户进行编辑和创作。

- 教育和学习辅助:可帮助学生和教师进行语言学习、作业辅导及知识测试。

- 编程辅助:Qwen2.5-Coder 模型专注于编程任务,提供代码建议和调试支持。

- 数学问题解决:Qwen2.5-Math 模型支持中英文数学问题的解决,适用于教育和研究领域。

- 多语言翻译:可用于生成翻译文本,具备编码器-解码器架构的能力。

常见问题

Qwen2.5 在 MMLU-rudex(通用知识)、MBPP(代码能力)和 MATH(数学能力)基准测试中,分别取得了 86.8、88.2 和 83.1 的优异成绩,展示出其在多领域的强大性能。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号