Qwen2-Math是一款由阿里通义千问推出的开源AI模型,专为解决复杂数学问题而设计。基于Qwen2语言模型,Qwen2-Math经过专门的数学语料库预训练和指令微调,展现出在多个数学基准测试中的卓越表现,尤其在英语和中文数学问题上均取得了优异成绩。该模型正在积极开发多语言版本,致力于提升其解决高难度数学问题的能力。

Qwen2-Math是什么

Qwen2-Math是阿里通义千问推出的专用于数学解题的开源AI模型,基于Qwen2语言模型构建。它旨在解决复杂的数学问题,通过大量的数学专用语料库进行预训练和指令微调,获得了出色的性能。Qwen2-Math在英语和中文的数学问题上均表现优异,并且当前正致力于开发支持多种语言的版本,以提升其解决高难度问题的能力。

Qwen2-Math的主要功能

- 多步逻辑推理:能够处理需要复杂多步逻辑推理的高级数学问题。

- 竞赛题解答:具备解决国际数学奥林匹克(IMO)等数学竞赛题的能力。

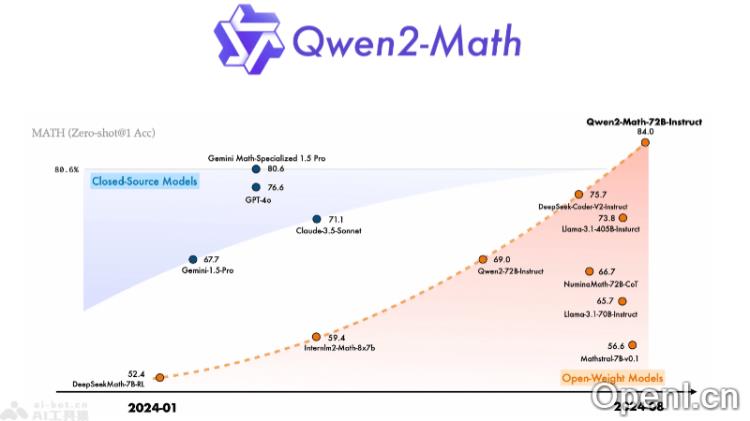

- 超越同类模型:在数学能力方面超越了许多其他开源模型,甚至部分闭源模型。

- 双语及多语言支持:目前主要支持英语,正在开发中英双语和其他多语言版本,以扩展其应用范围。

Qwen2-Math的技术原理

- 大规模预训练:模型通过大量的数学相关文本、书籍、代码和考试题目进行预训练,以建立对数学概念和问题解决策略的深刻理解。

- 专用语料库:预训练数据集经过精心设计,专注于数学领域,确保模型能够掌握数学语言和符号。

- 指令微调:在预训练的基础上,通过指令微调进一步优化模型,使其更好地理解和执行特定的数学解题指令。

- 奖励模型:采用奖励模型评估输出质量,通过正向反馈强化模型的正确解题行为。

- 二元信号:结合正确回答的二元信号(即模型是否给出了正确答案)作为监督信号来指导训练。

- 拒绝采样:构建监督微调数据集时使用拒绝采样方法,确保模型接触到高质量的输入和输出。

- PPO(Proximal Policy Optimization):运用强化学习算法进一步优化模型,提高其在特定任务上的表现。

- 数据去污染:在预训练和微调过程中,去除与测试集重叠的数据以避免数据泄露,确保评估的公正性。

产品官网

- 体验Demo:https://huggingface.co/spaces/Qwen/Qwen2-Math-Demo

- 项目官网:https://qwenlm.github.io/zh/blog/qwen2-math/

- GitHub仓库:https://github.com/QwenLM/Qwen2-Math

- Hugging Face模型库:https://huggingface.co/Qwen

Qwen2-Math的应用场景

- 教育辅助:支持学生学习数学概念,解决作业和练习题。

- 在线辅导:作为在线教育平台的辅助工具,提供即时的数学问题解答。

- 竞赛培训:用于数学竞赛的准备,提供难题解析和解题策略。

- 学术研究:协助研究人员进行数学建模、数据分析和算法开发。

- 工业应用:在需要复杂数学计算的工程和科学领域提供计算支持。

常见问题

- Qwen2-Math支持哪些语言?目前主要支持英语,正在开发中英双语和其他多语言版本。

- 如何使用Qwen2-Math?用户可以通过项目官网或Hugging Face平台体验该模型的Demo,获取更多信息和资源。

- Qwen2-Math的主要应用领域有哪些?广泛应用于教育、在线辅导、竞赛培训、学术研究和工业计算等多个场景。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号