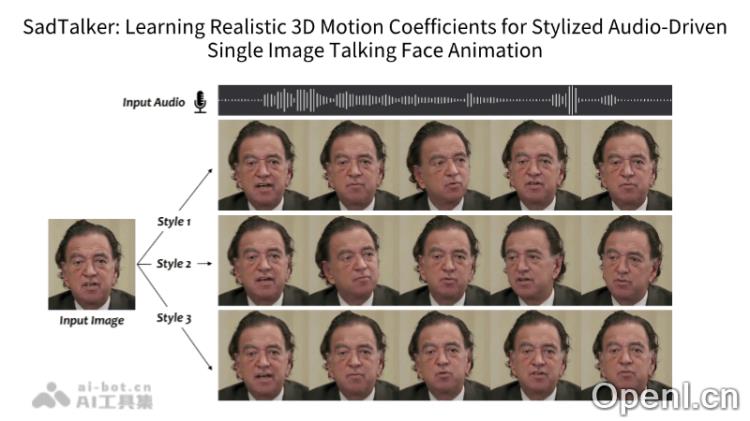

SadTalker是由西安交通大学、腾讯AI实验室和蚂蚁集团联合开发的开源AI数字人项目。该项目致力于通过单张人脸图像和音频输入,利用3D运动系数生成高度逼真的说话人脸动画。SadTalker采用了先进的技术,如ExpNet和PoseVAE,能够生成风格化且高质量的视频内容,并在多种语言和数据集上展现出良好的应用效果。

SadTalker是什么

SadTalker是一个开源的AI数字人项目,由西安交通大学、腾讯AI实验室和蚂蚁集团联合推出。它专注于利用一张人脸图像和相应的语音音频,通过3D运动系数生成生动的说话人脸动画。该项目结合了ExpNet用于面部表情的精确学习,以及PoseVAE用于不同风格的头部运动合成,从而能够创造出高质量和个性化的视频动画。此外,SadTalker提供了丰富的视频演示和消融研究,展示了其在多种语言和数据集中的应用效果。

SadTalker的主要功能

- 3D运动系数生成:提取音频中的头部姿态和表情的3D运动系数。

- ExpNet:专门设计的神经网络,用于从音频中学习面部表情。

- PoseVAE:条件变分自编码器,用于生成不同风格的头部运动。

- 3D面部渲染:将3D运动系数映射到3D关键点空间,生成风格化的面部动画。

- 多语言支持:处理多种语言的音频输入,生成对应的说话动画。

SadTalker的技术原理

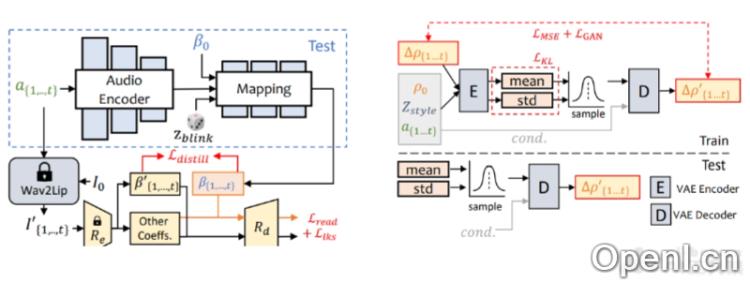

- 3D运动系数学习:通过分析音频信号,SadTalker学习3D运动系数,包括头部姿态和面部表情,这些都是3D形态模型(3DMM)的关键参数。

- ExpNet(表情网络):提取音频中的面部表情信息,通过学习音频与面部表情之间的映射关系,生成准确的面部表情动画。

- PoseVAE(头部姿态变分自编码器):此模型用于合成自然和风格化的头部姿态,能够基于音频信号生成不同风格的运动。

- 3D面部渲染:利用创新的3D面部渲染技术,将学习的3D运动系数映射到3D关键点空间,生成逼真的面部动画。

- 多模态学习:SadTalker在训练中同时考虑音频和视觉信息,从而提高动画的自然度和准确性。

- 风格化处理:根据需求生成不同风格的人脸动画,涉及对面部特征和运动的非线性变换,以适应不同的视觉风格。

- 无监督学习:采用无监督学习方法生成3D关键点,不需要大量标注数据即可学习有效的运动模式。

- 数据融合:通过音频和视觉数据的融合,SadTalker能够生成与音频同步且表情自然的说话人脸动画。

SadTalker的项目地址

- GitHub仓库:https://sadtalker.github.io/

- Hugging Face模型库:https://huggingface.co/spaces/vinthony/SadTalker

- arXiv技术论文:https://arxiv.org/pdf/2211.12194

SadTalker的应用场景

- 虚拟助手和客服:为虚拟助手或在线客服提供生动的面部动画,提升用户体验。

- 视频制作:在视频制作过程中,SadTalker可用于生成角色的面部动画,降低传统动作捕捉的成本和时间。

- 语言学习应用:为语言学习软件提供多语言的发音和面部表情,帮助学习者更好地理解和模仿。

- 社交媒体和娱乐:用户可以创建个性化的虚拟形象,用于社交媒体或娱乐内容的分享。

- 教育和培训:在远程教学或在线培训中,SadTalker能够为讲师提供虚拟形象,增强互动性。

常见问题

1. SadTalker支持哪些语言?

SadTalker支持多种语言的音频输入,能够生成相应语言的说话动画。

2. 我可以如何使用SadTalker?

您可以访问SadTalker的GitHub仓库或者Hugging Face模型库,获取详细的使用说明和示例。

3. SadTalker的应用范围有哪些?

SadTalker可广泛应用于虚拟助手、视频制作、语言学习、社交媒体和教育培训等多个领域。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号