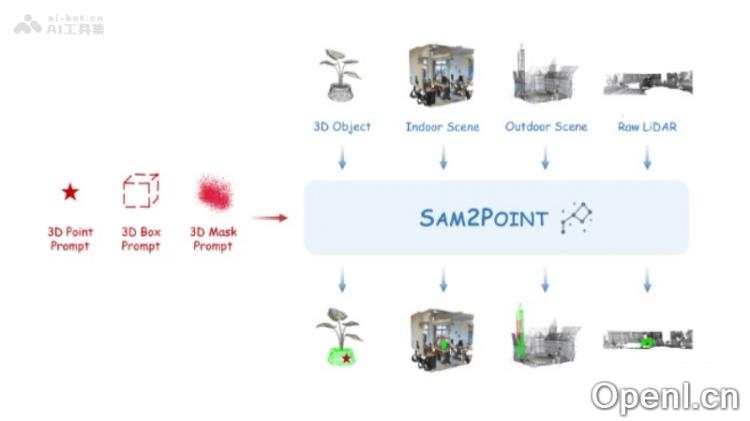

SAM2Point是一项基于先进SAM2技术的3D分割解决方案,能够在无需额外训练或2D-3D映射的情况下,直接对任意3D数据进行零样本分割。通过将3D数据体素化并模拟为多方向视频流,SAM2Point能够实现精准的空间分割。这项技术支持多种3D提示形式,如点、框和掩码,展现了其在不同场景下的广泛适应能力,适用于3D物体、室内外环境以及LiDAR数据,为未来3D可提示分割研究开辟了新方向。

SAM2Point是什么

SAM2Point是一个创新的3D分割工具,基于SAM2技术,能够在没有额外训练和2D-3D投影的情况下,进行零样本分割。它通过将3D数据转化为体素,并模拟为多方向的视频流,确保了分割过程中的空间信息得以保留。SAM2Point具备多种3D提示类型的支持,使其在多样的应用场景中表现出色,包括3D物体、室内外环境和LiDAR数据,为3D可提示分割的研究提供了新的起点。

SAM2Point的主要功能

- 无映射的3D分割:通过将3D数据转化为视频格式,SAM2Point避免了复杂的2D-3D映射,确保了高效的零样本3D分割,并保留了丰富的空间信息。

- 多样化的提示支持:能够接受3D点、3D框和3D掩码三种提示形式,增强了交互式分割的灵活性和准确性。

- 卓越的泛化能力:在多种3D场景中,SAM2Point展现出优越的泛化性能,能够处理单个物体、室内外环境及原始LiDAR数据,具有良好的跨领域适应能力。

- 推动3D研究:为研究人员提供强大工具,推动3D视觉、计算机图形学和自动驾驶等领域的研究进展。

SAM2Point的技术原理

- 3D数据体素化:将连续的三维模型或场景转换为离散的体素网格,其中每个体素代表空间中的一个体积元素。

- 多方向视频表示:将体素化的数据解读为多方向的视频流,每个方向代表从不同视角观察3D数据的一系列图像。

- 零样本学习:依赖于预训练模型的泛化能力,在未见特定类别样本的情况下进行分割。

- 提示工程:通过用户提供的3D提示(如点、框、掩码)来引导模型的分割过程,提高对目标区域的识别效率。

- 并行处理:同时处理多个视频流,每个流代表3D数据的一个视角,以提升分割效率。

SAM2Point的项目地址

- 项目官网:sam2point.github.io

- GitHub仓库:https://github.com/ZiyuGuo99/SAM2Point

- HuggingFace Demo体验:https://huggingface.co/spaces/ZiyuG/SAM2Point

- arXiv技术论文:https://arxiv.org/pdf/2408.16768

SAM2Point的应用场景

- 自动驾驶:在自动驾驶系统中,SAM2Point可用于分割和识别道路上的障碍物、行人和车辆,从而提升导航与决策的精准度。

- 机器人视觉:对执行复杂任务的机器人而言,SAM2Point助力其更好地理解周围的3D环境,实现精准的物体识别与抓取。

- 虚拟现实(VR)与增强现实(AR):在VR与AR应用中,SAM2Point用于实时环境理解与交互,提供更丰富且沉浸的用户体验。

- 城市规划与建筑设计:在城市规划与建筑设计中,SAM2Point帮助分析与理解3D模型,从而优化设计与规划流程。

- 游戏开发:在游戏开发领域,SAM2Point用于创建更真实的3D环境和物体,增强游戏的视觉效果与互动性。

常见问题

- SAM2Point的兼容性如何?:SAM2Point能够与多种3D数据格式兼容,支持广泛的应用场景。

- 使用SAM2Point需要特定的硬件吗?:为了获得最佳性能,建议使用具备较强计算能力的硬件,尤其是在处理大型3D数据时。

- 如何获取SAM2Point的技术支持?:用户可以通过项目官网或GitHub仓库获取相关的技术支持和文档。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号