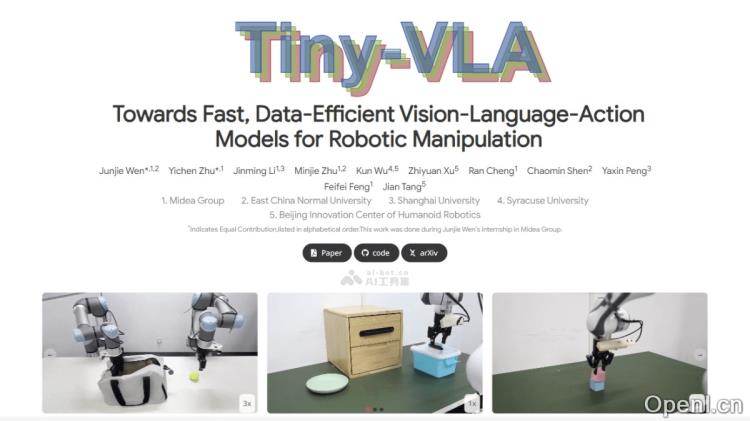

TinyVLA是一种新型的视觉-语言-动作(VLA)模型,专为机器人操控设计,由华东师范大学和上海大学的研究团队共同开发。与传统的VLA模型相比,TinyVLA在推理速度和数据需求方面表现出色,采用了先进的轻量级多模态架构和扩散策略解码器,显著提高了处理效率,并减少了对大规模数据集的依赖。经过在模拟及实际机器人平台上的深入测试,TinyVLA在速度、数据效率以及多任务学习和泛化能力方面均优于现有的领先模型OpenVLA,展现了其在资源受限环境中快速部署和应用的潜力。

TinyVLA是什么

TinyVLA是一款专为机器人操控而设计的视觉-语言-动作(VLA)模型,由华东师范大学和上海大学的团队共同研发。该模型针对现有VLA模型的不足之处,如推理速度缓慢和对大规模数据预训练的高需求,提出了有效的解决方案。TinyVLA采用了轻量级的多模态模型和扩散策略解码器,显著提升了推理速度,并减少了对数据集的依赖。经过广泛的模拟和实际应用测试,TinyVLA在速度、数据利用率、以及多任务处理和泛化能力上均表现出色,为机器人控制领域提供了快速、高效的新方案,有望在资源有限的环境中实现快速的应用与推广。

TinyVLA的主要功能

- 快速推理: TinyVLA能够在极短时间内处理视觉信息和语言指令,迅速生成相应的机器人动作,显著提升决策和执行的效率。

- 数据高效: 该模型减少了对大规模机器人数据集的需求,避免了昂贵的预训练过程,从而降低了训练成本和资源消耗。

- 多任务处理: TinyVLA能够处理多种不同的任务,包括抓取、放置和堆积等,展现出卓越的多任务学习能力。

- 强泛化能力: 在全新环境、对象和指令的情况下,TinyVLA依然能够保持较高的执行成功率,展现出强大的泛化能力。

TinyVLA的技术原理

- 多模态模型初始化: TinyVLA基于预训练的多模态模型(如Pythia)构建策略网络,已在大量视觉与语言数据上进行训练,具备优秀的语义理解能力。

- 策略骨干优化: 通过训练轻量化的多模态模型(VLM),TinyVLA在保持性能的同时有效减少了模型参数量。

- 扩散策略解码器: 在微调阶段,TinyVLA采用扩散策略解码器直接输出机器人动作,取代传统的基于token的预测方法,从而提高动作预测的连贯性和准确性。

- LoRA微调技术: 通过低秩适应(LoRA)技术对预训练的VLM部分进行微调,仅更新模型中少量参数,从而保留模型的原有知识并提高训练效率。

- 一次性多步预测: TinyVLA能够一次性预测多个未来动作,而非逐步预测,提高了动作预测的连贯性及整体效率。

TinyVLA的项目地址

- 项目官网:tiny-vla.github.io

- GitHub仓库:https://github.com/lesjie-wen/tinyvla(即将开源)

- arXiv技术论文:https://arxiv.org/pdf/2409.12514v1

TinyVLA的应用场景

- 家庭自动化: 在智能家居环境中,TinyVLA使机器人能够理解自然语言指令并完成家务任务,例如整理物品、开关灯等。

- 工业自动化: 在制造和包装生产线上,TinyVLA能够控制机器人进行精密的组装、分拣和质量检测等工作。

- 服务机器人: 在餐饮或医疗服务领域,TinyVLA帮助机器人理解客户需求,从而提供点餐、送餐或导医等服务。

- 灾难响应: 在灾害救援场景中,TinyVLA为机器人提供指导,使其能够在复杂环境中有效进行搜索和救援任务。

- 教育和培训: TinyVLA作为教育机器人的核心,通过互动学习辅助儿童教育或专业技能培训。

- 实验室助理: 在科学实验室,TinyVLA指导机器人执行样品处理、化学分析等重复性工作。

常见问题

- TinyVLA是否支持多种语言指令? 是的,TinyVLA可以理解多种语言的指令,适应不同用户的需求。

- 如何获取TinyVLA的代码? TinyVLA的代码将在GitHub上开源,用户可以访问我们的GitHub仓库进行下载。

- TinyVLA的训练数据来源是什么? TinyVLA使用了多种公开的视觉和语言数据集进行训练,确保模型具备良好的语义理解能力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号