Transformer Debugger (TDB) 是一款由 OpenAI 对齐团队(Superalignment)开发的工具,旨在帮助研究人员和开发者深入解析和理解 Transformer 模型的内部机制及其行为特征。TDB 提供了一种无需编码的方式,使用户能够直观地探索模型结构,以及分析模型在处理特定输入时的反应。

Transformer Debugger是什么

Transformer Debugger (TDB) 是一款由 OpenAI 的对齐团队(Superalignment)开发的工具,旨在帮助研究人员和开发者更深入地理解和分析 Transformer 模型的内部结构和行为。Transformer 模型是一种深度学习架构,广泛应用于自然语言处理(NLP)领域,特别是在机器翻译、文本生成和理解等任务中。

TDB 的核心功能是提供了一种无需编写代码即可快速探索模型结构的方式,结合了自动可解释性技术和稀疏自动编码器,使得用户能够直观地查看和分析模型的特定行为,例如模型为何在给定的输入(prompt)下选择输出特定的token,或者模型的注意力机制为何关注输入文本中的某些特定部分。

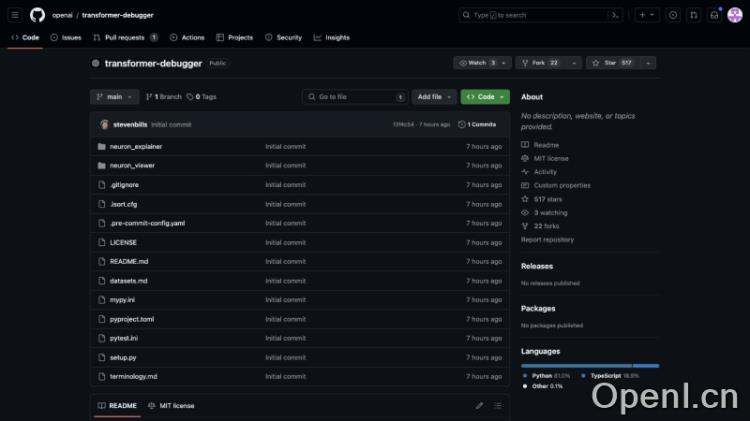

GitHub源码地址:https://github.com/openai/transformer-debugger

主要功能

- 无须编码的模型探索:TDB 使得用户能够在无需编写代码的情况下,轻松探索模型结构,提升了研究和调试的直观性与效率。

- 前向传递干预:用户能够干预模型的前向传递过程,观察不同操作对模型输出的影响,以更好地理解模型的决策机制。

- 组件级分析:TDB 能识别并分析对模型行为影响显著的特定组件,如神经元、注意力头和自动编码器的潜在表示(latents)。

- 自动生成解释:该工具能够自动生成解释,帮助用户了解特定组件激活的原因,从而深入理解模型的内部工作原理。

- 可视化界面:通过 Neuron viewer,这款基于 React 的应用程序,TDB 提供了一种用户友好的界面,展示和分析模型组件的信息。

- 后端支持:Activation server 作为后端服务器,为 TDB 提供必要的数据支持,包括从公共 Azure 存储桶读取和提供数据。

- 模型和数据集支持:开源内容包括 GPT-2 模型及其自动编码器的简单推理库,以及一些整理好的激活数据集示例,方便用户进行实验和分析。

产品官网

欲了解更多信息和获取源代码,请访问:GitHub – Transformer Debugger

应用场景

Transformer Debugger 可广泛应用于科研和开发领域,支持模型的调试、性能优化以及算法的可解释性研究。无论是在自然语言处理的学术研究,还是在商业产品的开发中,TDB 都能够帮助用户更高效地分析和理解复杂模型的行为。

常见问题

如何安装和设置 Transformer Debugger?

- 首先确保电脑上已安装 Python/pip 以及 Node/npm 等工具。

- 建议使用虚拟环境(非必选):

# 如果已在虚拟环境,先取消激活 deactivate # 创建新的虚拟环境 python -m venv ~/.virtualenvs/transformer-debugger # 激活新的虚拟环境 source ~/.virtualenvs/transformer-debugger/bin/activate

-

设置完环境后,按以下步骤进行操作:

git clone git@github.com:openai/transformer-debugger.git cd transformer-debugger # 安装神经元解释器 pip install -e . # 安装 pre-commit 钩子 pre-commit install # 安装神经元查看器 cd neuron_viewer npm install cd ..

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号