AIGC动态欢迎阅读

原标题:手机能跑!微软小模型击败Llama 2,96块A100 GPU训练14天,参数规模仅27亿

关键字:模型,微软,参数,报告,规模

文章来源:智东西

内容字数:5114字

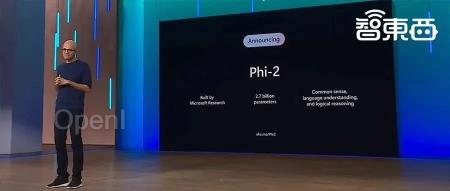

内容摘要:以小搏大!微软27亿参数模型击败Llama 2、Gemini Nano 2。作者|程茜编辑|李水青智东西12月13日报道,昨日晚间,微软又亮出了小模型大招!微软发布了27亿参数规模的小语言模型Phi-2,经研究人员测试,Phi-2在参数规模小于130亿的模型中展示了最先进性能。从性能表现看,Phi-2在Big Bench Hard(BBH)、常识推理、语言理解、数学和编码基准测试中,其平均性能得分已经超过70亿、130亿参数规模的Mistral和Llama 2,在部分基准测试中超过谷歌的Gemini Nano 2。Phi-2还有一大优势是,因为参数规模足够小,其可以在笔记本电脑、手机等移动设备上运行。过去几个月间,微软研究院的机器学习基础团队陆续发布了小型语言模型(SLM)Phi系列。其中,第一个模型为13亿参数规模的Phi-1,官方博客称,Phi-1在SLM中的Python编码方面表现最…

原文链接:点此阅读原文:手机能跑!微软小模型击败Llama 2,96块A100 GPU训练14天,参数规模仅27亿

联系作者

文章来源:智东西

作者微信:zhidxcom

作者简介:智能产业新媒体!智东西专注报道人工智能主导的前沿技术发展,和技术应用带来的千行百业产业升级。聚焦智能变革,服务产业升级。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...