AIGC动态欢迎阅读

原标题:梵高大跳科目三,只需文字+火柴人动效!可控视频生成框架来了 | AAAI 2024

关键字:姿势,腾讯,视频,时间,图像

文章来源:量子位

内容字数:3639字

内容摘要:

马跃 投稿量子位 | 公众号 QbitAI视频生成还可以这么玩?

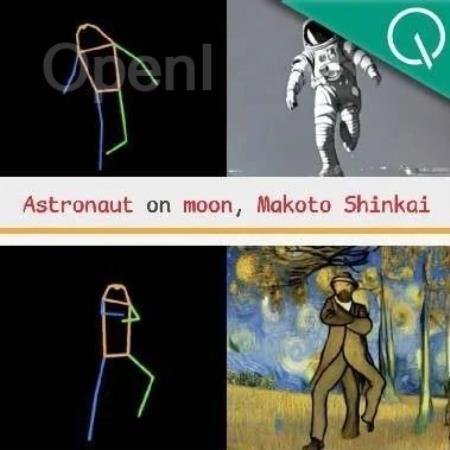

来一个“火柴人”做做动作示范,再加文本描述,即可让各种形象惟妙惟肖地跟着动起来。

比如男人在公园椅子上做远眺姿势:

钢铁侠街边起舞:

蝙蝠侠也不闲着,水上打拳:

形象数量可以随意添加:

风格也能任意切换(上:新海诚,下:梵高):

如此看下来,让任意一个八杆子打不着的形象跳个科目三,也是简简单单了。

如上成果便是不久前入选了AAAI 2024的姿态全可控视频生成框架:Follow-Your-Pose。

出自清华大学、香港科技大学、腾讯AI Lab以及中科院。

相关代码已在GitHub揽获800颗标星。

有网友惊叹,有了它:

TikTok/抖音的舞蹈将永远花样百出。

那么以下,为作者投稿内容,一起来看看它具体是如何做到的吧。

姿势可控的角生成来了现如今,生成文本可编辑和姿势可控的角在创建各种数字人方面具有迫切的需求。

然而,由于缺乏一个全面的、具有成对的视频-姿态-文本的生成数据集,从而使这项任务受到了限制。

在这项工作中,研究团队设计了一种新颖的两阶段训练方案,该方案可以利用易于获得的数据集(即图像姿势对和无姿

原文链接:梵高大跳科目三,只需文字+火柴人动效!可控视频生成框架来了 | AAAI 2024

联系作者

文章来源:量子位

作者微信:QbitAI

作者简介:追踪人工智能新趋势,关注科技行业新突破

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...