AIGC动态欢迎阅读

原标题:弥补中文短板,社区Llama3汉化微调版效果如何?

关键字:模型,中文,语料,能力,版本

文章来源:机器之心

内容字数:2686字

内容摘要:

Llama3自上个月发布以来,被称为社区最强开源模型。由于中文能力欠缺,为了弥补这一短板,开源社区已经出现了多个基于Llama3进行中文优化的微调模型。

这些微调模型大多采用了以下 2 条路线:

1、中文语料+SFT

2、中文语料+增训+SFT

和通过中文基准来评估模型的性能不同,我们想和大家一起来实测模型在不同场景下的实际表现,来看Llama3汉化后模型的能力,以提高模型被应用的效率。

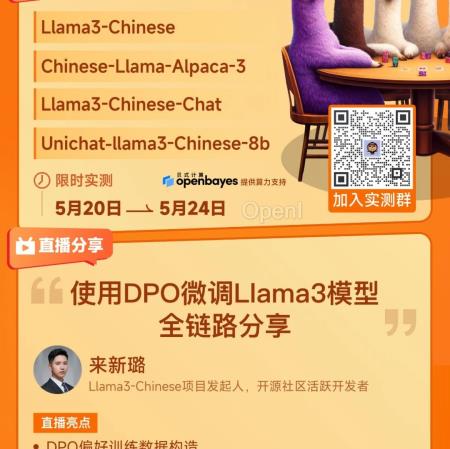

我们要怎么测模型?我们将会在5月20~5月24日开放以下模型项目供大家实际测试(开放地址:https://sota.jiqizhixin.com/xt-terminal)。项目名称微调技术方法项目地址

Chinese-LLaMA-Alpaca-3

v1版本(PT+SFT,基于非Instruct版训练):在原版Llama-3-8B的基础上使用约120GB大规模语料进行增量中文训练,并且利用高质量指令数据进行精调。

v2版本(SFT,基于Instruct版训练):直接采用500万条指令数据在Meta-Llama-3-8B-Instruct上进行精调。

https://sota.jiqizhixin.com

原文链接:弥补中文短板,社区Llama3汉化微调版效果如何?

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...