AIGC动态欢迎阅读

原标题:仅微调0.02%参数,性能接近全量微调!上交大推出高效微调统一新范式

关键字:空间,方法,权重,矩阵,研究者

文章来源:量子位

内容字数:0字

内容摘要:

ChouJay 投稿量子位 | 公众号 QbitAIScaling Laws当道,但随着大模型应用的发展,基础模型不断扩大的参数也成了令开发者们头疼的问题。

为了减轻训练负担,Adapter、Prompt-Tuning以及LoRA等高效微调(Parameter Efficient Fine-Tuning, PEFT)算法越来越受到大家伙的青睐。

那么,问题来了——

尽管近年来高效微调领域发展迅速,涌现了多种方法,但不同PEFT方法背后的数学基础几乎没有得到深入研究。

此外,不同PEFT方法之间的性能差异及其原因尚未系统地探讨。这种理论深度的缺乏限制了研究者对这些方法潜在优势和局限性的理解,阻碍了它们在实际应用中的优化和创新。

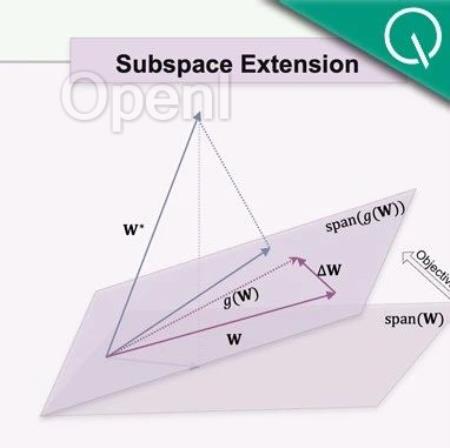

为了解决这一问题,来自上海交通大学的研究者们在对各种PEFT方法进行全面数学分析后,提出了一种新的框架——子空间微调,旨在将所有已知的PEFT方法统一在一个理论下,

具体来说,子空间微调方法主要集中于调整原始参数的子空间,涉及子空间的重构和扩展。研究者深入探讨了不同方法如何操作子空间,并从分解理论的角度阐明了每种方法的数学原理。此外,研究者分析了为什么这些方导

原文链接:仅微调0.02%参数,性能接近全量微调!上交大推出高效微调统一新范式

联系作者

文章来源:量子位

作者微信:

作者简介:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号