AIGC动态欢迎阅读

内容摘要:

机器之心报道

编辑:Panda W开源多模态大模型或将开始腾飞。值此 Llama 3.1 各大头条之际,又突然冒出了另一个也非常重要的发布 —— 一个规模空前的开源多模态数据集。

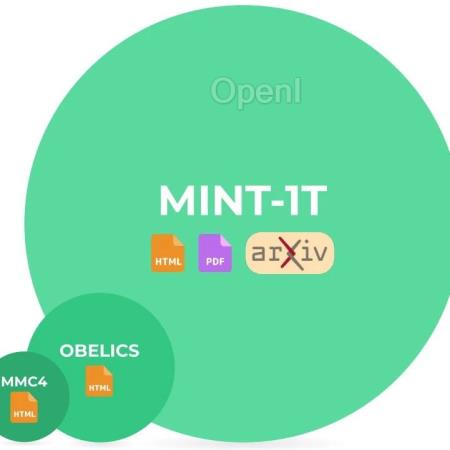

对大模型来说,数据集的重要性无需多言,甚至可以说没有大型数据集就不可能有大模型。现在正是多模态大模型(LMM)发展正盛的时候,规模足够大的优质且开源的多模态数据集已经成为该领域的一大「刚需」。不过,相比于开源的文本数据集,现有的开源多模态数据集都比较小、多样性也不足,并且来源基本都是 HTML 文档 —— 这就限制了数据的广度和多样性。这无疑限制了开源 LMM 的发展,让开源 LMM 与闭源 LMM 之间的差异变得非常大。

近日,华盛顿大学、Salesforce Research 和斯坦福大学等机构的联合团队填补了这一空白,构建了一个万亿 token 级的交织多模态的开源数据集 MINT-1T(Multimodal INTerleaved)。毫无疑问,这是目前最大的开源多模态数据集。数据集地址:https://github.com/mlfoundations/MINT-1T

论文地址:https://ar

原文链接:万亿token!史上最大多模态数据集诞生

联系作者

文章来源:机器之心

作者微信:

作者简介:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...