AIGC动态欢迎阅读

原标题:万字综述:全面梳理 FP8 训练和推理技术

关键字:精度,作者,模型,表示,尾数

文章来源:智猩猩AGI

内容字数:0字

内容摘要:

大模型时代最火AI芯片峰会来啦!!9月6-7日,由智猩猩联合主办的2024全球AI芯片峰会将在北京举行。峰会设有数据中心AI芯片、智算集群技术论坛等7大板块。目前,清华大学教授、集成电路学院副院长尹首一 ,AMD人工智能事业部高级总监王宏强,高通AI产品技术中国区负责人万卫星,摩尔线程高级产品总监付海良波等30+位嘉宾已确认参会。扫名~01背景随着 ChatGPT 的横空出世,LLM/AIGC 领域迎来空前的关注,各类大模型如雨后春笋般出现,科技公司对 AI 算力的需求也呈爆发式增长。在这样的背景下,如何在有限资源内提升模型训练和推理效率成为研究的热点。而在众多的方向中

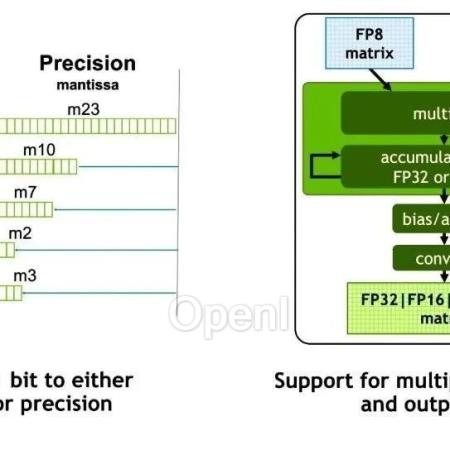

FP8 逐渐成为研究热点,FP8 的应用落地也是一个极具潜力的方向。

FP8 的重要性日益凸显,很大程度上得益于 NVIDIA Hopper 架构和 Ada Lovelace 架构对 FP8 的硬件支持。最新发布的 Blackwell 架构更是进一步拓展了低精度范围,支持了 FP6 和 FP4 格式。

业界对 FP8 的支持也在不断深入,我们也一直在关注业内对 FP8 的支持情况。比如各种推理框架(如 vLLM、T

联系作者

文章来源:智猩猩AGI

作者微信:

作者简介:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...