AIGC动态欢迎阅读

原标题:LLM 推理框架之上:10 种常见 LLM 推理系统总结

关键字:模型,实例,集群,节点,作者

文章来源:智猩猩AGI

内容字数:0字

内容摘要:

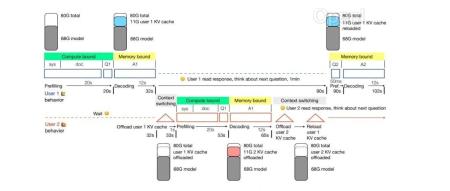

9月6-7日,智猩猩发起主办的2024全球AI芯片峰会将在北京辽宁大厦盛大举行。峰会设有开幕式、数据中心AI芯片专场、AI芯片架构创新专场、边缘/端侧AI芯片专场、智算集群技术论坛、Chiplet关键技术论坛、中国RISC-V计算芯片创新论坛。目前,终极议程已公布,50+位来自AI芯片、Chiplet、RISC-V、智算集群与AI Infra系统软件等领域的嘉宾,将带来报告、演讲、高端对话和圆桌Panel。扫名或购票~01背景当前常见的 LLM 推理框架通常是在单模型、同构硬件资源、均匀流量分布和有限序列长度等条件下优化其 Serving 能力。在这种情况下,各种分布式并行方案、量化压缩、算子优化、PagedAttention、Continuous Batching 等等技术可以充分发挥作用,提升服务吞吐量。然而,真实场景往往更加复杂,通常会包括以下几种情况:

多种 LLM 模型:不同的大小的模型,比如,常见的 7B、13B、70B 甚至上百 B 模型;或者同等大小但应用于不同垂类场景的模型。

异构硬件环境:不同的 GPU 类型,推理 GPU 可能包含 T4、L4、A30、4090

原文链接:LLM 推理框架之上:10 种常见 LLM 推理系统总结

联系作者

文章来源:智猩猩AGI

作者微信:

作者简介:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号