DanceFusion是一款由清华大学开发的开源框架,专注于音频驱动的舞蹈动作重建与生成。它结合了分层时空Transformer-VAE和扩散模型,能够处理社交媒体上出现的不完整和嘈杂的骨骼数据,从而生成与音乐完美同步的逼真舞蹈动作。DanceFusion利用先进的掩码策略和迭代扩散过程,优化动作序列,确保高保真度和音乐的一致性,广泛应用于内容创作、虚拟现实和互动娱乐等领域。

DanceFusion是什么

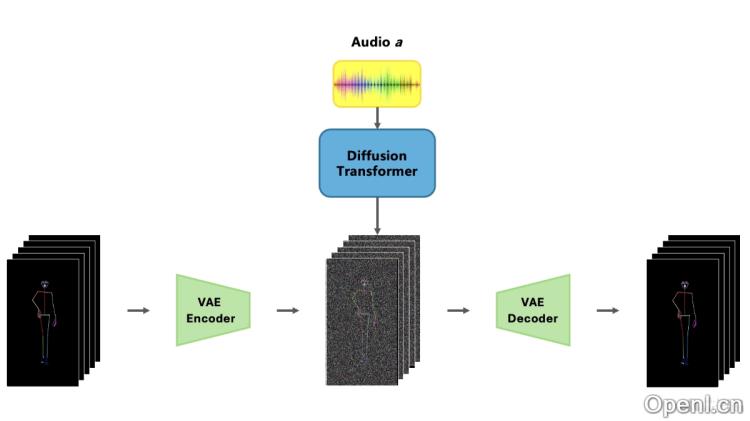

DanceFusion是由清华大学推出的一款开源框架,旨在实现音频驱动的舞蹈动作重建与生成。该框架通过结合分层时空Transformer-VAE和扩散模型,能够处理来自社交媒体平台的不完整及嘈杂的骨骼数据,生成与音乐节拍同步的真实舞蹈动作。DanceFusion的技术依赖于先进的掩码策略和迭代扩散过程,以优化动作序列,确保生成动作的高保真度和与音乐的同步性,广泛适用于内容创作、虚拟现实及互动娱乐等多个领域。

DanceFusion的主要功能

- 音频驱动的舞蹈动作生成:根据音频生成与其完美同步的舞蹈动作,适合处理社交媒体平台如TikTok上提取的骨骼数据。

- 处理不完整和嘈杂的数据:框架能够有效应对关节缺失、遮挡及噪声问题,利用分层时空VAE精确捕捉骨骼序列的空间与时间信息。

- 音频与动作的精确同步:基于扩散模型,确保舞蹈动作在节奏、旋律和情感上的完美契合。

- 先进的掩码策略:开发的掩码机制能够处理不完整的骨骼数据,确保模型在重建过程中只关注可靠的关节信息。

- 生成高质量舞蹈动作:框架能够生成高质量、逼真的舞蹈动作序列,具备高度的多样性和风格。

DanceFusion的技术原理

- 分层时空VAE编码:

- 空间编码:将每个骨骼关节视为一个token,有效捕捉关节间的空间关系。

- 时间编码:学习帧间的时间依赖性,确保动作序列在时间上的连贯性与流畅性。

- 扩散模型:从噪声骨骼序列开始,逐步优化迭代,提升动作的逼真度与音频的同步性。

- 掩码机制:在编码阶段应用掩码机制,标记关节的存在与缺失状态,避免模型处理缺失的关节。

- 音频特征融合:在迭代过程中融入音频特征,使生成的动作与音乐实现精准的同步。

- 实验评估:使用FID和多样性评分对生成的舞蹈序列进行质量评估,确保输出的多样性及非重复性。

DanceFusion的项目地址

DanceFusion的应用场景

- 内容创作:生成与音乐同步的舞蹈视频,适用于社交媒体和视频制作。

- 虚拟现实与增强现实:为虚拟角色提供自然的舞蹈动作,增强用户的沉浸感。

- 互动娱乐和游戏:在游戏中生成逼真的舞蹈动作,提升玩家的游戏体验。

- 舞蹈教育与培训:作为教学示范,帮助学习者掌握舞蹈技巧。

- 动画与电影制作:为虚拟角色生成复杂的舞蹈动作,减少对动作捕捉的依赖。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号