网友:赶紧在RAG中试试

最新图线性化方法助力Transformer架构理解复杂图结构

近期,机器学习工程师Rohan Paul分享了一项关于图线性化的新方法,该方法旨在将图(Graph)转换为适用于Transformer架构的线性token序列。这一研究不仅提升了大语言模型(LLM)对图结构的理解能力,还为图推理任务提供了新的思路。

1. 图线性化的关键属性

这种新方法强调两个重要属性:局部依赖性和全局对齐性。局部依赖性确保了模型能够基于前文上下文预测下一个token,而全局对齐性则要求不同图的token序列应从有相似特征的token开始或结束,类似于自然语言文本的结构。

2. 具体实现技术

研究团队提出了多种技术来实现图的线性化。其中包括:

- 图中心性方法:根据节点的度和PageRank值对节点进行排序,选择重要性高的节点及其连接的边,并随机排列。

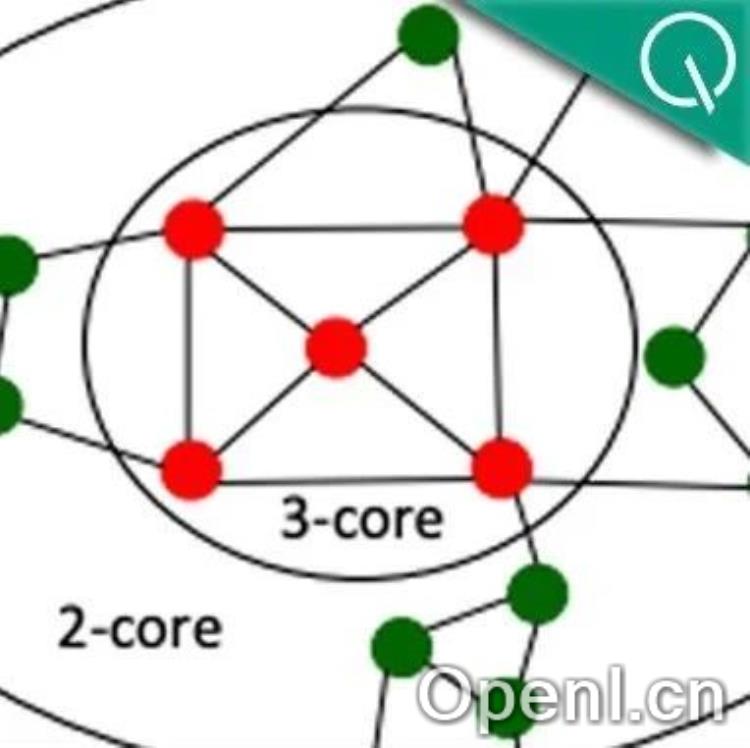

- 图退化性方法:通过k-core分解对图进行排序,捕捉图中的核心部分。

- 边排序策略:将图转换为线图,对线图中的节点进行排序以实现线性化。

- 节点重标记策略:对不同图中重要性相近的节点进行统一重标记,以保持全局对齐。

3. 实验与评估

作者使用GraphWave生成的数据集进行了评估,生成了3000个包含不同基本形状的图。实验设计了节点计数、最大度计算和图案形状分类三项任务,并与基线方法进行了对比。结果显示,基于度中心性和PageRank的线性化方法在多个任务中表现优异,尤其在节点计数任务中,准确率明显高于基线方法。

4. 研究结论

研究表明,基于中心性的方法总体优于基于退化性的方法。此外,在节点计数任务中,尽管所有方法的平均误差较低,但准确率存在差异,显示出节点重标记策略的效果因任务而异。值得注意的是,one-shot设置的性能普遍低于zero-shot,表明示例并不总是有助于性能提升。

通过这一新方法,LLM在处理复杂图结构时的表现将进一步改善,为未来的图推理任务奠定基础。

联系作者

文章来源:量子位

作者微信:

作者简介:追踪人工智能新趋势,关注科技行业新突破

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号