ILLUME – 华为诺亚方舟实验室推出的统一多模态大模型

ILLUME是什么

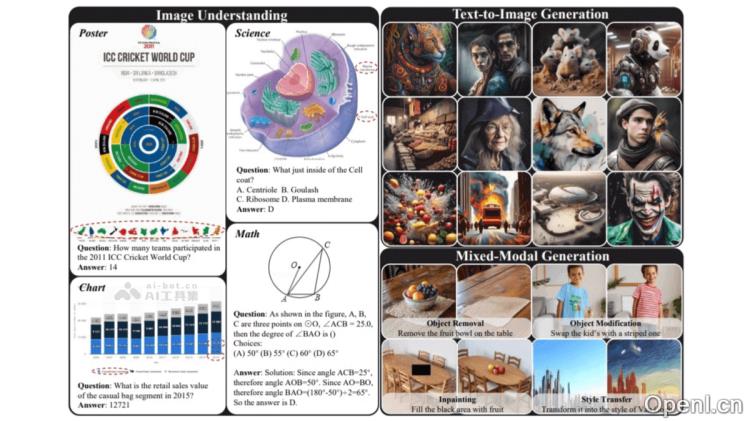

ILLUME是华为诺亚方舟实验室研发的一种统一多模态大模型,旨在将视觉理解和生成能力结合在同一框架中。该模型以大型语言模型(LLM)为核心,采用“连续图像输入 + 离散图像输出”的设计,整合了多模态的理解与生成能力,充分挖掘了在统一架构下理解与生成能力协同增强的潜力。ILLUME通过引入语义视觉分词器和三阶段训练流程,实现了高效的训练,使用仅15M的数据量便达到了与现有统一多模态大模型相当的性能。

ILLUME的主要功能

- 多模态理解与生成的融合:ILLUME可以在一个大型语言模型中无缝融合视觉理解与生成功能,借助统一的“下一个token预测”公式实现。

- 高效的数据利用:通过设计一个整合语义信息的视觉分词器和渐进式的多阶段训练流程,ILLUME将预训练的数据集规模缩减至仅15M。

- 自增强多模态对齐策略:ILLUME引入了一种创新的自我增强多模态对齐方案,以监督MLLM自我评估文本描述与自动生成图像之间的一致性,从而帮助模型更准确地解析图像,避免生成不切实际或错误的图像。

- 广泛的多模态任务处理能力:ILLUME能够处理包括视觉理解(如自然图像和文档图表)、生成和编辑等多种任务,并在这些领域表现出与专用单任务模型相媲美的效果。

- 连续图像输入与离散图像输出:该模型支持连续图像输入,允许用户上传一系列图像帧,非常适合视频分析和动态场景识别。同时,通过离散图像输出设计,可以根据输入的文本或其他模态数据生成一张或多张的图像。

- 协同作用机制:ILLUME的核心在于其统一框架下的协同机制,利用同一神经网络结构,使得理解与生成功能间的信息传递更加高效流畅。

ILLUME的技术原理

- 统一的多模态大模型(MLLM):ILLUME通过统一的“下一个token预测”公式,将视觉理解与生成能力整合到单一的大型语言模型中。

- 语义视觉分词器:为了提升数据使用效率,ILLUME设计了一种语义视觉分词器,该分词器将图像量化为离散的token,并嵌入语义信息,显著加速了图像与文本的对齐过程。

- 三阶段训练流程:ILLUME采用渐进式的多阶段训练程序,包括视觉嵌入初始化、图文对齐和多模态任务训练,有效减少了预训练所需数据量至15M,仅为传统需求的四分之一。

ILLUME的项目地址

- arXiv技术论文:https://arxiv.org/pdf/2412.06673

ILLUME的应用场景

- 视频分析与动态场景识别:ILLUME模型的连续图像输入方式使其特别适合于视频分析和动态场景识别,能够捕捉图像序列中的时间变化和空间关系,提供更加详细和全面的分析结果。

- 医疗诊断:通过学量医学影像和病历文本数据,ILLUME能够生成与实际病情相符的诊断图像,为医生提供支持,帮助其发现数据背后隐含的深层次关系,为医学研究开辟新思路。

- 自动驾驶:在自动驾驶系统中,ILLUME可处理来自摄像头、雷达等多种传感器的数据,提升系统的响应速度和可靠性,实时分析车辆周围的动态情况,预测潜在风险并及时采取措施。

- 智能客服:ILLUME通过协同处理用户的语音和文本输入,提供更个性化和精准的服务,能够根据用户的情绪、语气和问题内容,生成更贴切的回复,提高用户满意度。

- 艺术创作:ILLUME能够根据描述性文字生成多个不同的插图选项,供艺术家选择最合适的图像,保持生成图像的高度一致性和准确性,为创作者提供无穷的灵感来源。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...