Memory Layers – Meta 开源不增加算力时增加大模型的参数方法

Memory Layers是Meta推出的一种创新技术,旨在通过可训练的键值查找机制为模型增加额外的参数,而无需增加浮点运算次数(FLOPs)。这种基于稀疏激活的机制能够有效补充计算密集型的前馈层,以低成本存储和检索信息。Memory Layers在大规模语言模型中表现出卓越的实用性,尤其是在处理事实性任务时,显著提升了模型的性能。

Memory Layers是什么

Memory Layers是Meta研发的技术,采用可训练的键值查找机制来为模型扩展额外的参数,同时不增加计算负担(即不增加FLOPs)。这种技术通过稀疏激活机制补充计算密集的前馈层,提供了一种经济的方式来存储和检索信息。Memory Layers在大型语言模型中表现出显著的优势,尤其在涉及事实性任务时,能够有效提升模型的准确性和知识获取能力。

Memory Layers的主要功能

- 参数扩展:允许在不增加计算负担的前提下扩充模型参数,提高模型的容量。

- 信息存储与检索:提供一种专门的机制来存储和检索信息。

- 补充密集层:与计算密集型前馈层相辅相成,基于稀疏激活模式提供专用的信息存储和检索能力。

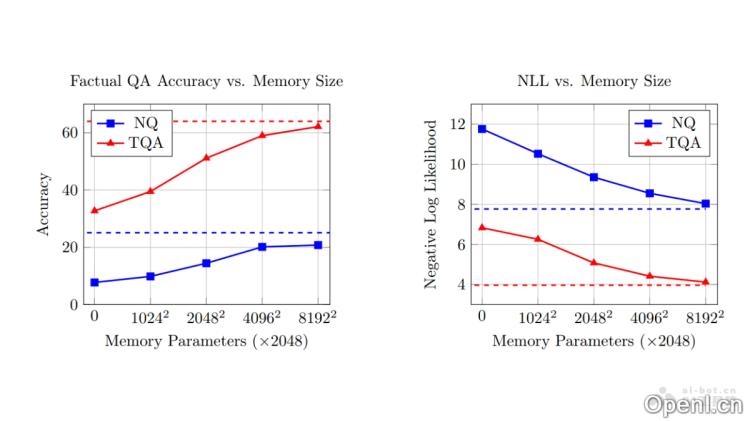

- 提高事实准确性:在事实性任务中,显著提升语言模型的准确性,使模型更有效地记忆和运用训练数据中的事实。

- 性能提升:在计算和参数配置相匹配的情况下,使模型的性能超过传统的密集模型和混合专家模型。

Memory Layers的技术原理

- 键值查找机制:基于简单的键值查找机制运作,键和值都被编码为嵌入向量。给定查询向量q和一组键K及值V,输出是根据q与相应键的相似度计算得出的值的软组合。

- 稀疏激活:与传统注意力机制不同,Memory Layers中使用的键和值是可训练的参数,而非激活值。由于键和值的数量通常较多,Memory Layers通过稀疏查找和更新机制,只有与查询最相似的top-k键及其对应值参与输出计算。

- 产品键查找:为了解决大规模记忆中查询-键检索的瓶颈,Memory Layers采用产品量化键(product-quantized keys),用两组较小的键有效进行全键集的top-k查找。

- 并行化实现:Memory Layers对内存的需求较大,在多个GPU上并行化嵌入查找和聚合,支持大规模扩展。

- 共享记忆参数:通过共享的记忆参数池,基于多个记忆层提升性能,而不增加参数数量。

Memory Layers的项目地址

- 项目官网:https://ai.meta.com/research/publications/memory-layers-at-scale/

- GitHub仓库:https://github.com/facebookresearch/memory

- arXiv技术论文:https://arxiv.org/pdf/2412.09764

Memory Layers的应用场景

- 问答系统:在问答系统中,帮助模型记住和检索大量事实信息,提供准确的回答。

- 语言模型:在自然语言处理领域,增强语言模型的记忆能力,使其在处理长文本和复杂对话时更加高效。

- 推荐系统:在推荐系统中存储用户的历史行为及偏好,以提供更个性化的推荐。

- 知识图谱:在知识图谱的应用中,存储和检索实体之间的关系,支持复杂的查询和推理。

- 对话系统:在对话系统中,帮助模型记住对话历史,使对话更加连贯和自然。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...