基于反事实学习的新型联邦学习框架。

浙江大学研究团队提出FedCFA:基于反事实学习的联邦学习框架

本文介绍了浙江大学人工智能研究所研究团队提出的FedCFA框架,该框架旨在解决联邦学习中因数据异质性导致的辛普森悖论问题,并已被AAAI 2025接收。FedCFA通过在客户端本地生成反事实样本,使本地数据分布更接近全局分布,从而提高模型的准确性。

1. 联邦学习中的辛普森悖论

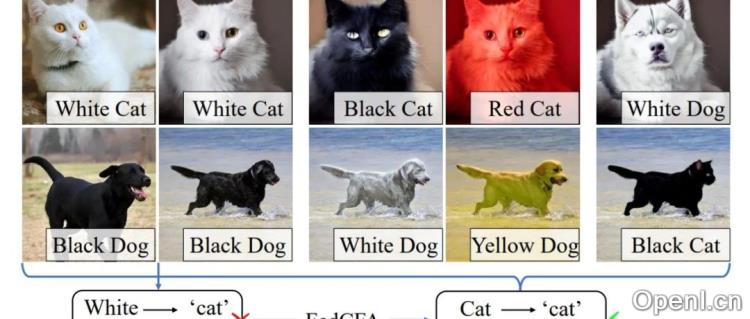

联邦学习允许多个客户端在不共享数据的情况下协同训练模型,但客户端数据异质性(Non-IID)会导致辛普森悖论:局部数据趋势一致,但全局数据趋势相反。这使得聚合的全局模型无法准确反映所有客户端的数据分布,影响模型准确性。例如,在猫狗图像分类任务中,如果每个客户端的数据都显示浅色动物是猫,深色动物是狗,则聚合模型可能错误地将颜色与类别关联。

2. 反事实学习的应用

反事实学习通过生成与现实数据不同的虚拟样本,探索不同条件下的模型行为,帮助模型更好地理解数据中的因果关系,避免学习到虚假的关联。在联邦学习中,反事实学习可缓解辛普森悖论,使全局模型更准确地反映整体数据分布。

3. FedCFA框架简介

FedCFA框架的核心思想是利用反事实学习来解决联邦学习中的辛普森悖论。它通过在客户端生成与全局平均数据对齐的反事实样本,使本地数据分布更接近全局分布,从而避免模型学习到错误的特征-标签关联。FedCFA包含以下关键步骤:

4. 全局平均数据集的构建

FedCFA利用中心极限定理构建全局平均数据集,近似全局数据分布。具体步骤包括:1. 本地平均数据集计算:每个客户端将本地数据集随机划分为多个子集,计算每个子集的平均值,生成本地平均数据集;2. 全局平均数据集计算:服务器端聚合来自多个客户端的本地平均数据,计算全局平均数据集。

5. 反事实变换模块

反事实变换模块在端侧生成与全局数据对齐的反事实样本。该模块包括:1. 特征提取;2. 选择关键特征(梯度大小);3. 生成反事实样本(用全局平均数据特征替换可替换特征因子)。为了提高反事实样本的质量,FedCFA 引入了因子去相关损失,减少提取出的特征因子之间的相关性。

6. 因子去相关损失

为了确保每个特征因子只携带单一信息,FedCFA 引入了因子去相关损失 (FDC),通过计算每对特征之间的皮尔逊相关系数,并将其作为正则化项加入到总损失函数中,减少特征之间的相关性。

7. 实验结果

实验结果表明,在具有辛普森悖论的数据集上,FedCFA 的全局模型精度高于 FedAvg 和 FedMix,并且达到目标精度所需的通信轮数更少。这证明了 FedCFA 在缓解辛普森悖论和提高联邦学习模型准确性方面的有效性。

8. 总结

FedCFA 框架通过巧妙地结合反事实学习和联邦学习,有效地解决了联邦学习中数据异质性导致的辛普森悖论问题,为提高联邦学习模型的准确性和鲁棒性提供了一种新的思路。该研究成果为未来联邦学习的研究提供了重要的参考价值。

联系作者

文章来源:机器之心

作者微信:

作者简介:专业的人工智能媒体和产业服务平台

粤公网安备 44011502001135号

粤公网安备 44011502001135号