MotionCanvas – 港中文和 Adobe 等机构推出的可控图像到视频生成方法

MotionCanvas是什么

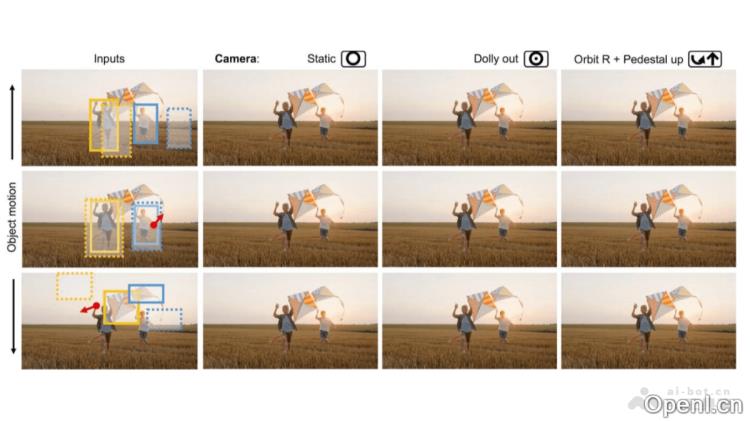

MotionCanvas是由香港中文大学、Adobe研究院和莫纳什大合开发的一种图像到视频生成技术,旨在将静态图像转变为富有动态效果的短片。这一创新技术引入了设计模块,使得用户能够直观地规划相机和物体的,从而实现复杂的镜头设计。通过信号转换模块,MotionCanvas能够将用户在三维空间中的意图精确地转化为二维屏幕空间的控制信号,进而驱动视频生成模型输出高质量的视频内容。此外,MotionCanvas还支持对相机和物体进行联合控制,能够精细化地管理物体的局部,生成复杂轨迹的长视频。

MotionCanvas的主要功能

- 相机与物体的联合控制:用户能够在输入图像上直观设计相机的轨迹(如平移、旋转、变焦等)以及物体的全局(如移动和缩放)和局部(如手臂摆动等)。

- 基于3D感知的控制:系统通过深度估计和信号转换模块,能够实现三维场景空间的设计,并将其转变为二维屏幕空间的信号,从而生成具有三维感知效果的视频。

- 长视频生成能力:支持生成任意长度的视频,能够实现复杂的轨迹和连贯的镜头设计。

- 多样化应用场景:可应用于简单的视频编辑任务,比如转移和基于初始帧的编辑视频生成。

MotionCanvas的技术原理

- 设计模块:用户将输入图像视作“画布”,在三维场景空间中设计相机和物体的。相机是基于指定关键帧的相机姿态实现,而物体则是通过场景锚定的边界框和稀疏点轨迹来定义。

- 信号转换模块:该模块将用户在三维空间中设计的意图转化为二维屏幕空间中的信号。它依靠深度估计和相机参数估计,将三维相机路径转变为二维点轨迹,并将场景锚定的边界框和点轨迹转换为屏幕空间信号。

- 条件视频生成模型:该模型基于预训练的DiT(Diffusion Transformer)模型进行微调,使其能够根据屏幕空间中的条件生成视频。通过编码点轨迹和边界框序列作为条件信号,该模型生成符合用户设计意图的视频。

- 自回归生成技术:通过自回归的方法,将生成的视频片段作为后续生成的条件,逐步生成连续的视频内容,有效避免直接生成长视频时可能出现的不连贯问题。

MotionCanvas的项目地址

MotionCanvas的应用场景

- 电影与视频制作:能够快速设计复杂的镜头效果,将静态图像转化为动态视频,适用于广告、宣传等领域,显著提升视觉吸引力。

- 动画创作:支持生成动画预览和角色动作,从静态故事板或图像中提取动态效果,提高创作的效率。

- 虚拟现实与增强现实体验:为VR和AR应用生成动态场景,增强用户的沉浸感,并支持实时交互。

- 游戏开发:用于制作游戏过场动画和动态场景,提升游戏叙事性和视觉效果,为玩家带来更丰富的体验。

- 教育与培训:将静态教学图像转化为动态视频,应用于课堂讲解和专业模拟训练,增强教学的趣味性和效果。

常见问题

- MotionCanvas支持哪些图像格式?:MotionCanvas支持多种常见的图像格式,具体可在官网查看。

- 是否需要专业的技术背景才能使用MotionCanvas?:不需要,MotionCanvas设计了用户友好的界面,任何人都可以轻松上手。

- 生成的视频质量如何?:MotionCanvas能够生成高质量的视频,具体效果可参考官网展示的样例。

- 是否支持实时编辑?:MotionCanvas支持实时设计和预览效果,用户可以即时看到编辑的结果。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号