Goku – 港大和字节联合推出的最新视频生成模型

Goku是一款由香港大学与字节跳动联合开发的最新视频生成模型,专注于图像与视频的协同生成。其核心优势在于能够高效生成高质量视频,显著降低广告视频制作成本(比传统方法低100倍)。Goku基于先进的rectified flow Transformer架构,具有多种生成模式,包括文本生成视频、图像生成视频及文本生成图像等。

Goku是什么

Goku是香港大学与字节跳动合作推出的前沿视频生成技术,旨在实现图像和视频的联合生成。该模型依托于一流的rectified flow Transformer框架,支持多种生成方式,如文本生成视频、图像生成视频及文本生成图像等。Goku的主要优势体现在其出色的视频生成质量和极低的广告视频制作成本(低于传统方式100倍)。在研发过程中,Goku利用了大规模高质量数据集,包括约3600万段视频和1.6亿张图像,结合多模态大语言模型以确保生成内容的语境一致性。该模型还实现了先进的并行处理策略和容错机制,以确保训练过程的高效性和稳定性。此外,Goku的扩展版本Goku+专注于广告场景,能够生成稳定且表现丰富的视频内容。

Goku的主要功能

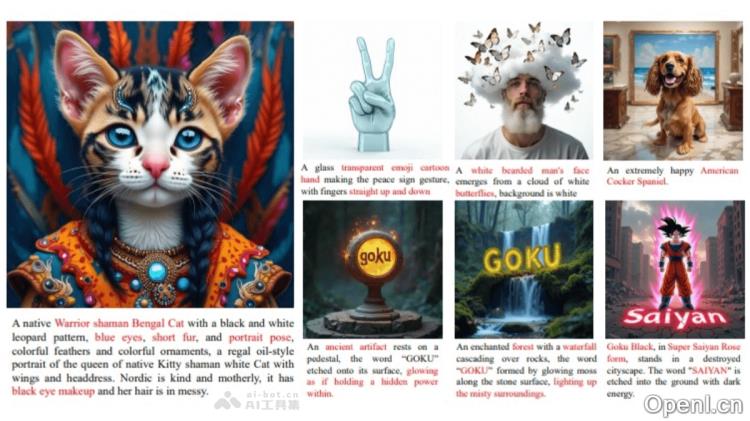

- 文本到图像(Text-to-Image):根据用户提供的文本描述生成高质量图像,确保图像细节丰富且与文本高度一致。

- 文本到视频(Text-to-Video):通过文本描述生成连贯的视频,保证视频中动作流畅且画面质量高。

- 图像到视频(Image-to-Video):基于输入的图像生成动态视频,保持视觉风格与语义一致,适用于动画和视频创作。

- 广告视频生成(Goku+):专门为广告制作而设计,能够生成高质量的广告视频,支持人物与产品的自然互动,大幅降作成本。

- 虚拟数字人视频生成:创建逼真的虚拟数字人视频,展现自然的动作,适合用于虚拟主播和客服等多种场景。

- 多模态生成:支持多种生成任务,能够无缝处理图像、视频和文本的复杂时空依赖关系。

Goku的技术原理

- 图像-视频联合VAE:Goku使用3D联合图像-视频变分自编码器,将图像和视频输入压缩至共享的潜在空间,从而在统一框架中处理多种媒体格式。

- Transformer架构:Goku的模型家族包含2B和8B参数的Transformer架构,基于全注意力机制,能够有效处理图像和视频的复杂时空关系。

- 校正流公式:Goku利用Rectified Flow(RF)算法,通过线性插值在先验分布与目标数据分布之间进行训练,展现出比传统扩散模型更快的收敛速度。

- 多阶段训练策略:采用包括图文语义对齐预训练、图像-视频联合训练和针对不同模态的微调的多阶段训练策略,逐步提升生成能力。

- 大规模高质量数据集:构建了约3600万段视频和1.6亿张图像的数据集,运用多种数据过滤和增强技术以提高数据质量。

- 高效的训练基础设施:Goku的训练基础设施包括并行策略、细粒度激活检查点技术和容错机制,显著提升了训练效率与稳定性。

Goku的项目地址

- 项目官网:https://saiyan-world.github.io/goku/

- Github仓库:https://github.com/Saiyan-World/goku

- HuggingFace模型库:https://huggingface.co/datasets/saiyan-world/Goku

- arXiv技术论文:https://arxiv.org/pdf/2502.04896

Goku的应用场景

- 广告视频制作:Goku+能够根据文本生成高质量广告视频,支持从文本直接生成视频、从产品图像生成互动视频,以及产品展示视频的制作。

- 虚拟数字人视频生成:Goku+可以将文本转化为超现实的人类视频,生成超过20秒的视频,具备稳定的手部动作与逼真的面部及身体表情。

- 内容创作:Goku可以生成多种场景的视频,包括动画、自然风光、动物行为等,为艺术创作者提供丰富的创作灵感。

- 教育与培训:Goku可用于制作生动的教育视频和培训课程,增强教学效果和趣味性。

- 娱乐产业:在电影、电视剧和动画制作中,Goku可用于内容生成与特效制作,提供高质量视频内容,扩展创作可能性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号