Qihoo-T2X – 360 AI 研究院和中山大学开源的高效多模态生成模型

Qihoo-T2X是什么

Qihoo-T2X 是由360 AI 研究院与中山大合开发的一款高效多模态生成模型,基于代理标记化扩散 Transformer(PT-DiT)架构。该模型引入了稀疏代理标记注意力机制,显著减少了传统扩散 Transformer 在全局自注意力计算中的冗余,结合窗口注意力和移位窗口注意力,提升了细节建模的能力。Qihoo-T2X 可支持多项任务,包括文本到图像(T2I)、文本到视频(T2V)以及文本到多视图(T2MV)生成。

Qihoo-T2X的主要功能

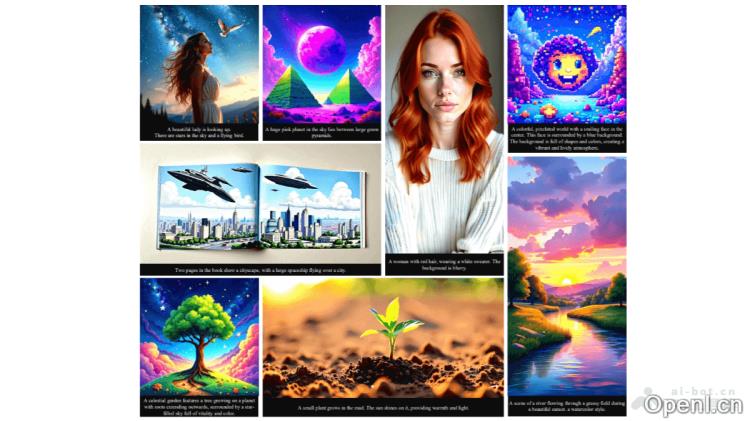

- 文本到图像生成:根据用户输入的文本描述,生成高质量且分辨率极高的图像,确保生成内容与文本描述高度一致,适合用于创意设计和艺术创作等领域。

- 文本到视频生成:能够根据文本描述生成连贯的视频内容,支持动态场景和视频序列的生成,适用于视频创作和动画制作。

- 文本到多视图生成:根据文本描述生成同一物体或场景的多角度图像,适合于3D对象的多视角展示,支持虚拟现实(VR)和增强现实(AR)应用。

- 高效生成能力:基于优化的代理标记化注意力机制,显著降低了计算复杂度,使得高分辨率图像和长视频的生成更加高效,从而减少了训练和推理成本。

Qihoo-T2X的技术原理

- 代理标记化注意力机制:传统的扩散 Transformer 采用全局自注意力机制,计算复杂度较高且存在冗余。PT-DiT 通过在每个时空窗口内计算平均标记作为代理标记,减少了计算量,并通过交叉注意力机制将全局语义信息注入所有潜在标记,确保有效的信息传播。

- 窗口注意力与移位窗口注意力:为增强局部细节建模,PT-DiT 引入窗口注意力机制,针对局部窗口内的标记进行自注意力计算。移位窗口注意力机制则用于避免窗口划分造成的“网格效应”,进一步提升生成质量。

- 稀疏代理标记的高效处理:通过稀疏代理标记机制,PT-DiT 在处理高分辨率图像和长视频时,显著降低了计算复杂度,同时保持生成内容的质量。

- 多任务适应能力:PT-DiT 的架构设计允许其无缝适应图像生成、视频生成和多视图生成等多种任务,无需进行重大结构调整。

Qihoo-T2X的项目地址

- 项目官网:https://360cvgroup.github.io/Qihoo-T2X/

- GitHub仓库:https://github.com/360CVGroup/Qihoo-T2X

- arXiv技术论文:https://arxiv.org/pdf/2409.04005

Qihoo-T2X的应用场景

- 创意设计与艺术创作:基于文本描述,快速生成高质量艺术图像,支持多种风格,助力设计流程,加速艺术家的创意灵感。

- 视频内容生成:生成连贯的动画视频,适合于广告、宣传以及动画制作,降低视频创作的成本和时间。

- 教育与培训:生成教学用图像和视频,帮助学生理解复杂概念,支持虚拟实验室和动态教学资源。

- 娱乐与游戏开发:生成虚拟场景、角色和动态内容,适用于游戏开发、虚拟现实(VR)和增强现实(AR)应用,提升用户沉浸感。

- 广告与营销:快速生成个性化的广告图像和视频,提高营销效果,满足品牌视觉内容的需求。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号