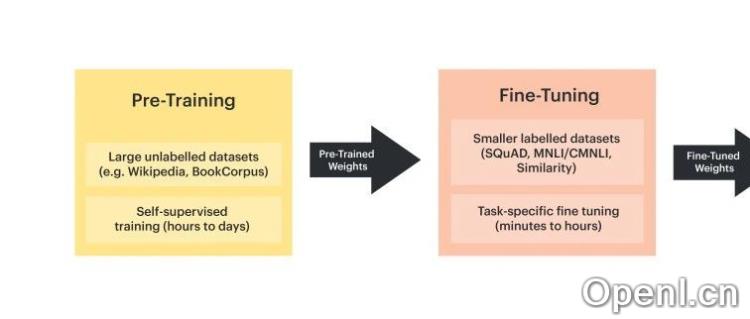

预训练和微调是现代AI模型的核心技术,通过两者的结合,机器能够在处理复杂任务时表现得更为高效和精准。\x0d\x0a\x0d\x0a预训练为模型提供了广泛的语言能力,而微调则确保了模型能够根据特定任务进行细化和优化。

原标题:一文说清楚什么是预训练(Pre-Training)、微调(Fine-Tuning)

文章来源:AI取经路

内容字数:5451字

预训练与微调:赋能AI模型的黄金组合

人工智能的飞速发展,特别是自然语言处理(NLP)领域的突破,离不开两项关键技术的贡献:预训练和微调。这两者如同模型的“左右手”,协同作战,让AI模型在处理复杂任务时更加高效精准。

什么是预训练?

预训练,如同一位学生接受基础教育,旨在为模型奠定坚实的语言基础。它利用海量通用数据(例如,大量的书籍、文章、网页等)对模型进行初步训练,让模型学言的结构、语义以及各种模式。这就好比学生学文、数学、历史等基础学科,为未来的专业学习打下基础。

预训练的关键点

预训练虽然强大,但也面临一些挑战。首先,它需要巨大的计算资源和数据,这不仅成本高昂,也带来能源消耗的担忧。其次,预训练模型通常较为“通用”,可能无法完全满足特定任务的需求。如何平衡通用性与针对性,是预训练领域持续探索的方向。最后,确保模型学习到的语言模式具有良好的泛化能力,避免过度依赖特定数据集,也是一个重要的研究课题。

预训练的通俗类比

想象一下,预训练就像学生在大学入学前接受的通识教育,学习各种基础课程,例如语文、数学、历史等。这些课程虽然不针对某个特定专业,但却为学生提供了广泛的知识基础,为未来的专业学习做好准备。

什么是微调?

微调则如同学生进入大学后学习专业课程,它是在预训练的基础上,利用特定任务的数据集对模型进行进一步训练,目标是让模型在特定任务上达到最佳性能。例如,如果我们要训练一个情感分析模型,微调阶段就会使用标注了情感标签的数据集对预训练模型进行优化,使其能够更准确地识别文本的情感。

微调的关键点

微调的关键在于如何在保证模型不“忘记”预训练阶段学到的通用知识的同时,使其在特定任务上取得最佳性能。这需要精细的调参和策略选择。此外,当微调数据量较少,或者微调数据与预训练数据存在差异时,模型的泛化能力可能会受到影响,需要采取一些技术手段来解决这个问题。

微调的通俗类比

微调就像学生在大学里学习专业课程,例如医学、计算机等。学生已经具备了基础知识,但他们需要专注于特定学科,深入研究这个领域。他们会根据未来的职业目标,选择特定的课程进行学习,并不断提升自身的专业技能。

预训练与微调的区别

预训练和微调的主要区别在于其目标和训练数据。预训练旨在学言的普遍规律,使用大规模通用数据集;微调则针对特定任务,使用特定任务数据集,目标是优化模型在该任务上的性能。预训练注重模型的泛化能力,微调注重模型的特定任务性能。

总结

预训练和微调是现代AI模型的基石,它们相辅相成,共同推动着人工智能技术的发展。预训练赋予模型强大的语言能力,微调则确保模型能够适应各种特定任务。未来,随着技术的进步,预训练和微调技术将在更多领域发挥重要作用,为我们带来更加智能、便捷的生活。

联系作者

文章来源:AI取经路

作者微信:

作者简介:踏上取经路,比抵达灵山更重要! AI技术、 AI知识 、 AI应用 、 人工智能 、 大语言模型