LDGen – 理想汽车推出的多语言文本到图像生成技术

LDGen是什么

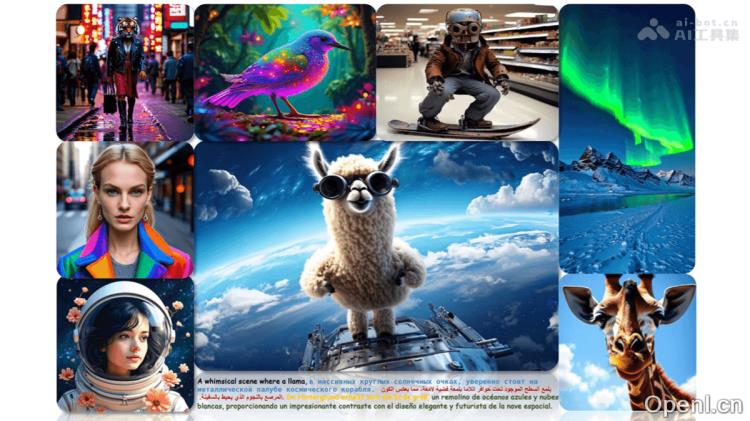

LDGen是一种前沿的文本到图像合成技术,通过将大型语言模型(LLMs)与扩散模型相结合,显著提高了从文本描述生成图像的质量和语义一致性。该技术通过分层标题优化和人类指令技术提炼文本中的精准语义信息,并利用轻量级适配器实现LLMs与图像特征的高效对接与互动。LDGen还支持零样本多语言生成,能够根据多种语言的文本描述生成出色的图像,远超传统方法。

LDGen的主要功能

- 多语言零样本生成:LDGen结合了大型语言模型(LLM)与现有的文本到图像扩散模型,具备零样本多语言文本到图像生成的能力。即使在训练过程中仅使用英语提示,模型也能根据多种语言生成相应图像,极大增强了跨语言生成的能力。

- 语言表示优化:通过分层字幕优化和人工指令技术,LDGen提取出更为精确的语义信息,增强了文本与图像之间的语义对齐。这提高了生成图像的语义一致性,避免了因错误指令引起的虚假信息。

- 提升生成质量:在多次实验中,LDGen在指令遵循度和图像美学质量方面表现优于基线模型及其他增强方法,如PixArt-和ELLA等。

LDGen的技术原理

- 语言表示策略:LDGen采用分层字幕优化与人工指令技术以提取更精确的语义信息。通过生成不同长度的字幕,并结合人工指令的优化,模型能够更有效地捕捉图像内容的层次结构,同时避免因错误指令造成的虚假信息。

- LLM对齐模块:为了使LLM的特征与现有扩散模型的特征相对齐,LDGen设计了轻量级的适配器。该适配器通过调整LLM输出的特征空间,使其与T5等文本编码器的特征空间相匹配,实现高效特征对齐。

- 跨模态精炼器:LDGen引入了跨模态精炼器模块,以增强LLM特征与图像特征之间的互动。该模块通过自注意力机制、交叉注意力机制等组件优化LLM的特征表示,进一步提升文本与图像之间的语义对齐。

- 自注意力机制(Self-Attention):优化LLM特征的内部表示。

- 交叉注意力机制(Cross-Attention):以LLM特征作为查询(Query),图像特征作为键(Key)和值(Value),促进文本与图像间的深度互动。

- 可学习的缩放因子(Learnable Scaling Factors):在训练过程中动态平衡原始特征与优化后特征,确保从预训练权重到新特征的平滑过渡。

- 高效训练策略与效率:LDGen通过分阶段训练显著降低了计算需求:

- 特征对齐阶段:使用约8000万条文本数据进行LLM对齐模块的训练。

- 微调阶段:在512分辨率下使用2400万对文本-图像对进行微调。

- 高分辨率训练阶段:在1024分辨率下使用1400万条数据进行进一步训练。整个训练过程仅需约120个A100 GPU天,相比PixArt-α减少了约74%的计算资源。

LDGen的项目地址

- 项目官网:https://zrealli.github.io/LDGen/

- Github仓库:https://github.com/zrealli/LDGen

- arXiv技术论文:https://arxiv.org/pdf/2502.18302

LDGen的应用场景

- 艺术创作与设计:艺术家和设计师可以利用LDGen将创意描述转化为高质量图像,快速推动创作进程。能够迅速将文本描述转化为视觉内容,帮助创作者探索多样的设计方向。

- 广告与营销:在广告和营销领域,LDGen能够根据品牌风格或市场趋势快速生成吸引人的广告图像和社交媒体内容。通过文本描述直接生成图像,可以提升宣传材料的吸引力和个性化。

- 媒体与娱乐:LDGen适用于电影、游戏和动画制作中的概念艺术创作,能够生成场景和角色的初步视觉表现。在电影制作中,可以生成特效场景的初步草图,帮助导演和设计师快速预览场景布局。

- 教育:在教育领域,LDGen能够帮助学生和教师制作教学材料,如历史场景重现或科学概念的视觉化。通过文本描述生成图像,能够更直观地展示复杂的概念。

- 电子商务:在线零售商可利用LDGen生成产品的视觉展示,以展示服装在不同环境或不同模特身上的效果。帮助商家快速生成高质量的产品图片,提升用户体验。

常见问题

- LDGen的使用难度大吗?:LDGen的界面友好,用户可以通过简单的文本描述生成图像,不需要专业的技术背景。

- LDGen支持哪些语言?:LDGen支持多种语言的生成,用户只需提供相应语言的文本描述即可。

- 生成的图像质量如何?:LDGen在多项实验中显示出较高的生成质量,特别是在指令遵循和图像美学方面优于许多传统方法。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...