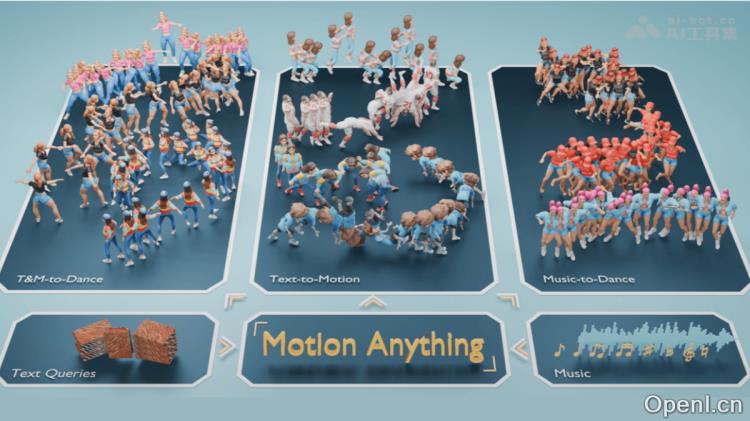

Motion Anything – 腾讯联合京东等高校推出的多模态生成框架

Motion Anything是什么

Motion Anything 是一个由澳大利亚国立大学、悉尼大学、腾讯、麦吉尔大学和京东等机构共同开发的多模态生成框架。它能够根据文本、音乐或二者的结合,生成高质量且可控的人类。该框架采用基于注意力机制的掩码建模方法,使得对序列中的关键帧和动作可以进行细致的调控,从而有效解决了现有技术在根据条件优先生成动态内容方面的不足。此外,Motion Anything还利用时间自适应和空间对齐的变换器,优化了多种模态条件的整合,提高了生成的连贯性与多样性。同时,Motion Anything推出了Text-Music-Dance () 数据集,包含2153对文本、音乐和舞蹈样本,为多模态生成的研究提供了新的基准。

Motion Anything的主要功能

- 多模态生成:基于文本描述、音乐或其组合,生成高质量的人类。

- 细致控制:通过注意力机制,实现对关键帧和动作的精细调控,达到更精准的生成效果。

- 动态优先级调整:根据输入的条件(如文本或音乐),动态调整生成的优先级,优先生成与条件相关性最高的动态帧和身体部位。

- 跨模态对齐:在时间和空间维度上对文本、音乐和进行有效对齐,从而提升生成的一致性和连贯性。

Motion Anything的技术原理

- 基于注意力的掩码建模:利用注意力机制选择与输入条件(文本或音乐)最相关的部分进行掩码处理。在生成过程中,模型优先恢复被掩码的关键帧和动作,聚焦于动态内容的生成。

- 时间自适应变换器:根据输入模态(文本、音乐或两者结合),动态调整注意力的计算方式,使的关键帧与文本关键词或音乐节拍进行对齐,增强时间维度的连贯性。

- 空间对齐变换器:对条件和嵌入进行重新排列,以揭示空间维度。恢复被掩码的关键动作,确保与条件在空间上保持一致性。

- 多模态条件编码:对文本、音乐等多种模态条件进行同时处理,利用自适应编码器将不同模态的信息整合到生成中,提高生成效果。

- 数据集支持:推出新的Text-Music-Dance () 数据集,包含2153对文本、音乐和舞蹈样本,为多模态生成提供了丰富的数据支持。

Motion Anything的项目地址

- 项目官网:https://steve-zeyu-zhang.github.io/MotionAnything/

- GitHub仓库:https://github.com/steve-zeyu-zhang/MotionAnything

- arXiv技术论文:https://arxiv.org/pdf/2503.06955

Motion Anything的应用场景

- 影视动画:快速生成高质量动画,降作成本,并提升视觉效果。

- 虚拟现实/增强现实:为虚拟角色创造逼真的动作,增强沉浸体验,实现自然交互。

- 游戏开发:根据剧情或音乐生成角色动作,提升游戏的趣味性与流畅度。

- 人机交互:生成自然动作,促使机器人与人类之间的友好互动,实现基于语音指令的动作生成。

- 教育与培训:生成标准动作示范,助力体育、舞蹈等领域的教学,提升培训效果。

常见问题

- 使用Motion Anything需要具备哪些技术背景?:用户需要具备基本的编程能力和对机器学习的了解,以便有效使用该框架。

- 可以使用Motion Anything生成什么类型的?:该框架可以生成多种类型的人类,包括舞蹈、体育动作等,具体类型取决于输入的文本和音乐。

- 如何获取Text-Music-Dance () 数据集?:用户可以通过项目官网或GitHub仓库获取该数据集,并遵循相应的使用条款。

- 是否可以定制生成的?:是的,用户可以通过调整输入的条件(文本和音乐)来定制生成的内容。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号