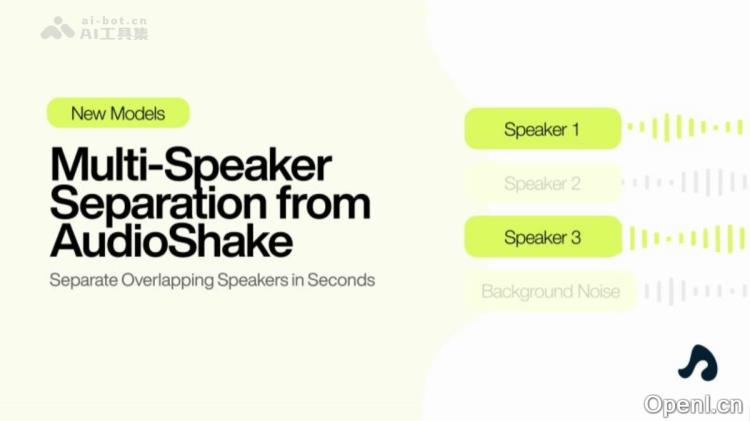

Multi-Speaker – AudioShake 推出的多说话人声分离模型

Multi-Speaker是由AudioShake推出的全球首个高分辨率多说话人分离模型,旨在精准分离音频中多个说话人的声音,解决传统音频工具在处理重叠语音时遇到的困难。该技术适用于多种应用场景,利用先进的神经网络架构支持高采样率,适合广播级音频处理,能够处理长达数小时的录音,在高重叠与低重叠情况下保持一致的分离效果,为音频编辑和创作带来变革性的提升。

Multi-Speaker是什么

Multi-Speaker是由AudioShake开发的全球首个高分辨率多说话人分离模型,能够将音频中的多个说话人精确分离到轨道。这项技术有效解决了传统音频处理工具在重叠语音处理中的不足。Multi-Speaker适用于多种应用场景,借助先进的神经网络架构,它支持高采样率,适合广播级音频制作,并能够处理长达数小时的录音。在高重叠和低重叠的场景中,它都能保持一致的分离效果,从而为音频编辑与创作带来性的变化。目前,Multi-Speaker已正式开放,用户可通过AudioShake Live和AudioShake的API接口进行接入和使用。

Multi-Speaker的主要功能

- 说话人分离:将不同说话人的语音提取到的音频轨道,方便进行单独编辑、音量调整或特效处理。

- 对话清理:去除背景噪音和其他干扰,提供清晰的对话轨道,提升整体音频质量。

- 高保真音频处理:支持高采样率,确保分离后的音频适合广播级制作标准。

- 长时录音处理:能够处理持续数小时的录音,确保分离效果的一致性。

Multi-Speaker的技术原理

- 深度学习模型:基于深度学习算法,通过大量音频数据训练模型,以识别和分离不同说话人的语音特征。

- 说话人识别与分离:该模型能够检测音频中的不同说话人,将它们的语音分别提取到的轨道,分析音频的声学特征(如音色、音调、节奏等)以区分不同的说话人。

- 高采样率处理:支持高采样率(如44.1kHz或48kHz),确保分离后的音频质量达到广播级标准。

- 动态处理能力:能够处理各种复杂场景,包括高重叠对话、背景噪音及长时间录音。基于优化算法,模型在不同场景下保持稳定的分离效果。

Multi-Speaker的项目地址

Multi-Speaker的应用场景

- 影视制作:能够分离多说话人的对话,便于后期编辑和配音工作。

- 播客制作:清理录音,分离嘉宾语音,从而提升音质。

- 无障碍服务:帮助残障人士以自己的声音进行交流。

- 用户生成内容(UGC):分离多说话人的音频,方便创作者进行编辑。

- 转录与字幕制作:减少字幕错误,提高字幕的准确性。

常见问题

- Multi-Speaker可以处理多长时间的录音?:它能够处理长达数小时的录音,保持一致的分离效果。

- 是否支持低质量音频的处理?:虽然该模型主要针对高质量音频,但在一定程度上也可以提升低质量音频的处理效果。

- 如何接入Multi-Speaker?:用户可通过AudioShake Live和AudioShake的API接口进行接入。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...