Baichuan-Omni是什么

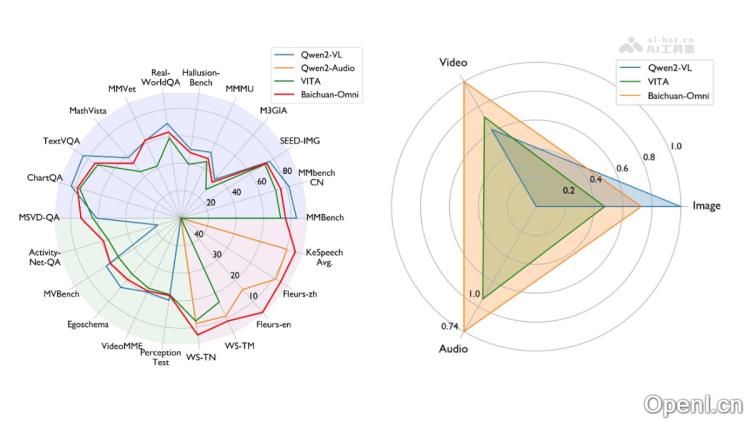

Baichuan-Omni 是百川智能推出的一款开源 7B 多模态大型语言模型(MLLM),具备同时处理和分析图像、视频、音频及文本等多种数据模态的能力。该模型为用户提供了前沿的多模态交互体验,展现出卓越的性能。Baichuan-Omni 采用了一种高效的多模态训练架构,涵盖了多模态对齐和多任务微调的两个阶段,使其能够有效处理视觉和音频信息。在各类多模态基准测试中,Baichuan-Omni 的表现超过了当前领先的全模态模型 VITA,并在图像、视频及音频模态评估中展现出更强的覆盖能力。

Baichuan-Omni的主要功能

- 多模态数据处理:支持同时处理图像、视频、音频和文本等多种数据模态。

- 多语言支持:可处理包括英语和汉语在内的多种语言。

- 高级交互体验:提供先进的多模态交互,能够理解并响应复杂的用户指令。

- 多模态对齐预训练:在预训练阶段,利用包含图像描述、交错数据、OCR数据和图像文本数据的丰富语料库进行整理。

- 多模态监督微调:在微调阶段,训练超过60万对多模态数据对,涵盖纯文本、音频、图像文本、视频文本和图像音频的交互数据。

Baichuan-Omni的技术原理

- 多模态架构:通过视觉编码器处理图像和视频数据,音频编码器处理音频信息,并结合大型语言模型(LLM)进行信息整合和处理。

- 多阶段训练:涵盖图像-语言、视频-语言和音频-语言的多模态对齐预训练,以及多模态监督微调。

- 数据构造:采用开源、合成及内部标注的数据集,构建高质量的多模态训练数据。

- 对齐策略:在预训练阶段,精细对齐不同模态的编码器与连接器,实现各模态间的高效交互。

- 注意力机制:运用注意力机制动态计算模型对多模态输入的权重,以理解和响应复杂指令。

Baichuan-Omni的项目地址

- GitHub仓库:https://github.com/westlake-baichuan-mllm/bc-omni

- arXiv技术论文:https://arxiv.org/pdf/2410.08565

Baichuan-Omni的应用场景

- 智能客服与机器人:Baichuan-Omni 能够理解并生成文本,同时处理音频和视觉信息,在构建智能客服系统和机器人方面展现出巨大的潜能,为用户提供更自然和丰富的交互体验。

- 内容审核与过滤:凭借其多模态理解能力,Baichuan-Omni 可用于审核图像、视频和文本内容,帮助识别与过滤不当内容,如暴力、或仇恨。

- 教育与培训:在教育领域,Baichuan-Omni 可作为教学辅助工具,提供语言学习、视觉识别及问题解答等功能,提升学生的学习体验。

- 辅助残障人士:可以开发针对残障人士的应用程序,如语音识别和图像描述,帮助视障或听障人士更好地理解和与周围环境互动。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号