MarDini是一款创新的视频生成模型,结合了掩码自回归(MAR)和扩散模型(DM)的优点,专为大规模视频生成而设计。它能够处理任意数量和位置的掩码帧,支持多种任务,包括视频插值、图像转视频生成及视频扩展。MarDini通过将大部分计算资源分配给低分辨率的规划模型,成功实现了空间-时间注意力机制的广泛应用,从而显著提升了视频生成的效率与灵活性。此外,MarDini无需依赖图像生成的预训练,可以从无标签数据中进行自我训练,展现出卓越的可扩展性和效率。

MarDini是什么

MarDini是一种新型的视频扩散模型,融合了掩码自回归(MAR)与扩散模型(DM)的优势,旨在提升大规模视频生成的能力。该模型能够灵活应对任意数量和位置的掩码帧,从而支持多种应用,如视频插值、图像转视频生成及视频扩展。MarDini有效地将计算资源重心放在低分辨率的规划模型上,利用空间-时间注意力机制的广泛应用,显著提升了生成效率和灵活性。该模型可以从无标签数据中进行端到端训练,避免了对图像生成预训练的依赖,展现出优秀的可扩展性与效率。

主要功能

- 视频插值:在两帧视频之间生成中间帧,实现流畅的过渡效果。

- 图像转视频生成:从单幅图像生成连续的视频内容,创造动态效果。

- 视频扩展:在现有视频基础上添加新帧,延长视频播放时长。

- 慢动作视频生成:利用自回归推断生成超出训练定义的额外帧,形成慢动作效果的视频。

- 零样本3D视图合成:无需3D数据训练,即可生成具有3D一致性的新视角画面。

技术原理

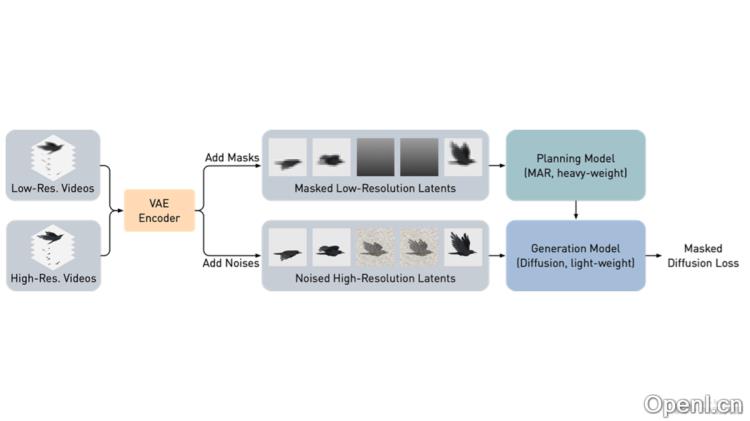

- 掩码自回归(MAR)与扩散模型(DM)的结合:MarDini通过MAR处理时间序列的长期依赖关系,同时利用DM专注于空间细节的生成。

- 不对称网络设计:MAR在低分辨率下运行,具备更多参数,而DM在高分辨率下则拥有较少参数,使得模型在低分辨率阶段能够处理更多计算任务,在高分辨率阶段专注于细节生成。

- 端到端训练:MarDini采用掩码帧级扩散损失,能够从无标签视频数据中进行全面训练。

- 灵活的掩码策略:根据不同任务需求,MarDini能够灵活调整掩码帧的数量和位置,适应多样化的视频生成任务。

- 渐进式训练策略:模型通过逐步调整掩码比例和任务难度,从视频插值逐渐过渡到完整视频生成。

项目地址

- 项目官网:mardini-vidgen.github.io

- arXiv技术论文:https://arxiv.org/pdf/2410.20280v1

应用场景

- 娱乐与社交媒体:MarDini可用于生成适合社交媒体分享的短视频内容,如自动生成的舞蹈视频、特效视频或用户定制的故事短片。

- 电影与视频制作:在电影后期制作中,MarDini可用于生成或增强特效场景,或用于创作电影预告片中的特定镜头。

- 游戏开发:MarDini在游戏开发中能够生成动态背景视频,或作为游戏角色动画的原型设计工具。

- 虚拟现实(VR)与增强现实(AR):MarDini用于生成VR或AR应用中的动态环境和场景,增强用户的沉浸体验。

- 广告与营销:MarDini可用于制作引人注目的广告视频,通过动态内容吸引潜在客户的关注。

常见问题

- MarDini是否支持实时视频生成?:MarDini的设计旨在提高生成效率,适用于实时或近实时的视频生成需求。

- 使用MarDini需要什么样的硬件支持?:虽然MarDini在低分辨率下运行,但推荐配置较高的GPU以获得更好的性能体验。

- MarDini支持哪些视频格式?:MarDini支持多种视频格式的输入和输出,具体格式可参见项目文档。

- 如何获取MarDini的最新更新?:用户可以通过项目官网和arXiv论文关注MarDini的最新动态与更新。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号