Aria-Base-64K官网

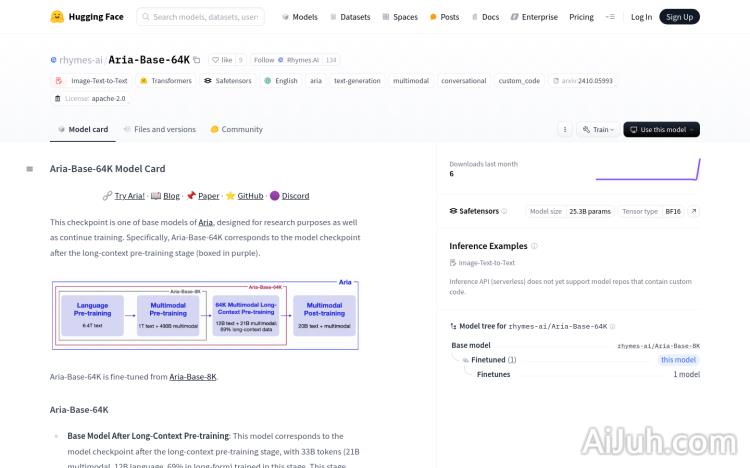

Aria-Base-64K是Aria系列的基础模型之一,专为研究目的和继续训练而设计。该模型在长文本预训练阶段后形成,经过33B个token(21B多模态,12B语言,69%为长文本)的训练。它适合于长视频问答数据集或长文档问答数据集的继续预训练或微调,即使在资源有限的情况下,也可以通过短指令调优数据集进行后训练,并转移到长文本问答场景。该模型能够理解多达250张高分辨率图像或多达500张中等分辨率图像,并在语言和多模态场景中保持强大的基础性能。

Aria-Base-64K是什么?

Aria-Base-64K是Rhymes AI推出的一款多模态预训练语言模型,它属于Aria系列的基础模型,主要面向研究人员和开发者。该模型经过330亿个token的训练(其中包含大量长文本数据),能够理解长文本和多达250张高分辨率图像或500张中等分辨率图像,在长视频问答和长文档问答等场景下表现出色。它特别适合需要处理长文本和多模态数据的场景,例如视频问答系统、长文档问答系统和图像文本联合推理应用的开发。

Aria-Base-64K的主要功能

Aria-Base-64K的主要功能包括:长文本理解、多模态理解、问答系统、预训练模型。它能够处理长文本和多模态数据,理解图像和文本之间的关联,并基于这些信息进行问答等任务。其强大的基础性能使其能够胜任多种复杂任务,并支持后续的微调和定制化开发。

如何使用Aria-Base-64K?

使用Aria-Base-64K需要以下步骤:首先,安装必要的库,例如transformers、accelerate和sentencepiece。然后,使用`AutoModelForCausalLM.from_pretrained`加载模型,并使用`AutoProcessor.from_pretrained`处理输入的文本和图像数据。接下来,将处理好的数据输入模型进行推理,最后使用处理器解码模型输出的token,得到最终结果。对于更高级的使用,例如自定义数据集上的微调,可以参考GitHub上的代码库。

Aria-Base-64K的产品价格

文章未提及Aria-Base-64K的具体价格信息,这可能是因为其主要面向研究和开发用途,而非商业化产品。建议访问Rhymes AI的官方网站或联系其团队以获取更多信息。

Aria-Base-64K的常见问题

Aria-Base-64K的训练数据量有多大?它在哪些数据集上进行了训练? Aria-Base-64K在330亿个token上进行了预训练,其中包含210亿个多模态token和120亿个语言token,数据来源未在文章中明确说明,但强调了其中69%为长文本数据。

Aria-Base-64K适合哪些类型的任务? Aria-Base-64K非常适合处理长文本和多模态数据的任务,例如长视频问答、长文档问答、图像文本联合推理等。它也能够用于其他需要强大语言理解和多模态能力的任务。

Aria-Base-64K与其他类似模型相比,有哪些优势? 文章提到Aria-Base-64K在语言和多模态场景中保持与Aria-Base-8K相同的强大基础性能,并且能够处理更长的文本和更多的图像。其低比例模板训练也使其更适用于特定任务的微调,而非直接用于。

Aria-Base-64K官网入口网址

https://huggingface.co/rhymes-ai/Aria-Base-64K

OpenI小编发现Aria-Base-64K网站非常受用户欢迎,请访问Aria-Base-64K网址入口试用。

数据评估

本站OpenI提供的Aria-Base-64K都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 1月 9日 上午10:35收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。

粤公网安备 44011502001135号

粤公网安备 44011502001135号