DeepSeek-VL2官网

DeepSeek-VL2是一系列大型Mixture-of-Experts视觉语言模型,相较于前代DeepSeek-VL有显著提升。该模型系列在视觉问答、光学字符识别、文档/表格/图表理解以及视觉定位等任务上展现出卓越的能力。DeepSeek-VL2包含三个变体:DeepSeek-VL2-Tiny、DeepSeek-VL2-Small和DeepSeek-VL2,分别拥有1.0B、2.8B和4.5B激活参数。DeepSeek-VL2在激活参数相似或更少的情况下,与现有的开源密集和MoE基础模型相比,达到了竞争性或最先进的性能。

DeepSeek-VL2是什么

DeepSeek-VL2是一款由DeepSeek-AI开发的大型视觉语言模型,它基于Mixture-of-Experts (MoE) 架构,能够理解图像和文本信息,并进行多模态交互。它拥有三个不同规模的版本:DeepSeek-VL2-Tiny (1.0B参数)、DeepSeek-VL2-Small (2.8B参数) 和 DeepSeek-VL2 (4.5B参数),以满足不同计算资源和应用场景的需求。该模型在视觉问答、光学字符识别、文档/表格/图表理解以及视觉定位等任务上表现出色,在同等规模或更小规模的模型中取得了领先或具有竞争力的性能。

DeepSeek-VL2主要功能

DeepSeek-VL2 的主要功能包括:视觉问答(理解并回答与图像相关的问题)、光学字符识别 (OCR,识别图像中的文字信息)、文档理解 (解析和理解文档内容)、表格/图表理解 (识别和理解表格及图表中的数据)、视觉定位 (识别图像中特定物体的位置)以及多模态交互 (结合视觉和语言信息,提供更丰富的交互体验)。

如何使用DeepSeek-VL2

使用 DeepSeek-VL2 需要以下步骤:1. 安装必要的依赖库,运行 `pip install -e .`;2. 指定模型路径,例如 `model_path = ‘deepseek-ai/deepseek-vl2-small’`;3. 加载模型和处理器,使用 `DeepseekVLV2Processor.from_pretrained(model_path)`;4. 准备输入数据,包括文本和图片;5. 使用 `prepare_inputs` 方法处理输入数据;6. 使用 `vl_gpt.language_model.generate` 运行模型并获取结果;7. 使用 `tokenizer.decode` 将模型输出的 token 序列解码为文本。

DeepSeek-VL2产品价格

目前官网并未公布DeepSeek-VL2 的具体价格信息,建议访问官网或联系 DeepSeek-AI 获取详细定价。

DeepSeek-VL2常见问题

DeepSeek-VL2 支持哪些类型的图像? DeepSeek-VL2 支持多种类型的图像,包括但不限于 JPEG、PNG 等常见格式。 建议您参考官方文档获取更详细的支持格式列表。

如何处理大型图像或文档?对于大型图像或文档,建议您将其分割成更小的块,分别进行处理后再进行整合。官方文档可能提供更优化的处理方法。

DeepSeek-VL2 的精度如何? DeepSeek-VL2 的精度取决于所使用的模型版本和任务类型。一般来说,参数量更大的模型精度更高。建议您在实际应用中进行测试,以评估其在特定任务上的性能。

DeepSeek-VL2官网入口网址

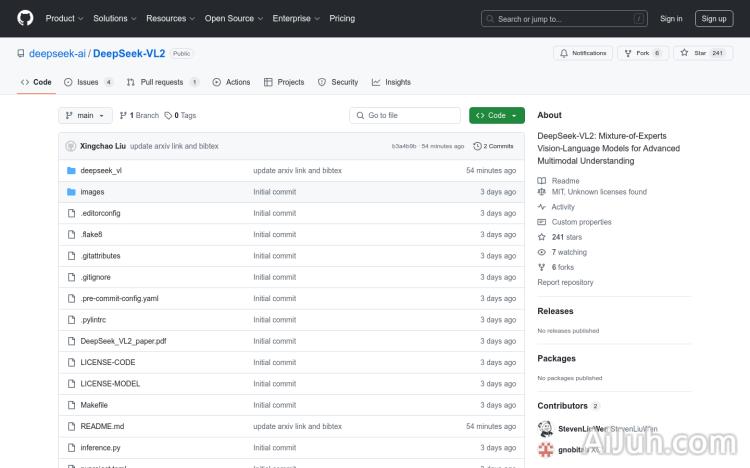

https://github.com/deepseek-ai/DeepSeek-VL2

OpenI小编发现DeepSeek-VL2网站非常受用户欢迎,请访问DeepSeek-VL2网址入口试用。

数据评估

本站OpenI提供的DeepSeek-VL2都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 1月 9日 下午12:17收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。