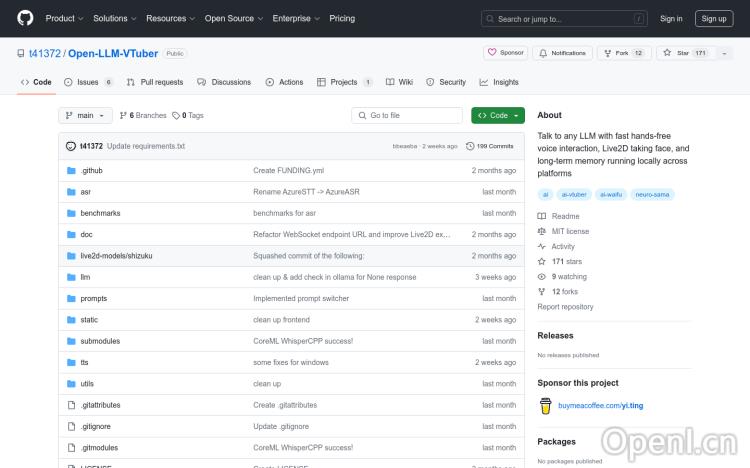

Open-LLM-VTuber官网

Open-LLM-VTuber 是一个开源项目,旨在通过语音与大型语言模型(LLM)进行交互,具有实时的Live2D面部捕捉和跨平台的长期记忆功能。该项目支持macOS、Windows和Linux平台,允许用户选择不同的语音识别和语音合成后端,以及自定义的长期记忆解决方案。它特别适合希望在不同平台上实现与AI进行自然语言对话的开发者和爱好者。

Open-LLM-VTuber是什么?

Open-LLM-VTuber是一个开源项目,它让用户可以通过语音与大型语言模型(LLM)进行实时交互。它最大的特色在于结合了Live2D实时面部捕捉技术,让你的AI助手拥有一个栩栩如生的虚拟形象。这个项目支持Windows、macOS和Linux系统,并允许用户自定义语音识别、语音合成以及长期记忆方案,实现跨平台的持续对话体验。简单来说,它就像一个可以和你的、拥有可爱面孔的AI虚拟主播。

Open-LLM-VTuber的主要功能

Open-LLM-VTuber的主要功能包括:免提语音交互、实时Live2D面部表情捕捉、跨平台支持(Windows、macOS、Linux)、可自定义的语音识别和合成后端、基于MemGPT的长期记忆功能,支持多种语言(包括中文)以及可选的GPU加速。

如何使用Open-LLM-VTuber?

Open-LLM-VTuber的使用相对来说比较技术性,需要一定的编程基础。你需要先安装必要的依赖项,例如FFmpeg和Python虚拟环境,然后克隆项目代码到本地。接下来,配置conf.yaml文件,选择你喜欢的语音识别和合成引擎。运行server.py启动WebSocket服务器,打开index.html启动前端界面,最后运行launch.py或main.py启动后端处理。之后,你就可以通过语音与LLM进行交互了,Live2D模型会根据对话内容实时改变表情。

Open-LLM-VTuber的产品价格

作为开源项目,Open-LLM-VTuber本身是免费的。但是,你需要自行承担使用过程中产生的其他费用,例如云服务费用(如果使用云端的LLM模型)以及语音识别和合成服务的费用(如果选择付费服务)。

Open-LLM-VTuber常见问题

我的电脑配置不够高,能运行Open-LLM-VTuber吗? 该项目支持在不同配置的电脑上运行。虽然GPU加速可以提升性能,但并非必需。你可以根据你的电脑配置调整设置,例如降低Live2D模型的复杂度或关闭GPU加速。

Open-LLM-VTuber支持哪些大型语言模型? 原则上支持任何与OpenAI API兼容的大型语言模型。 你需要在配置文件中指定你的LLM API密钥和相关参数。

如果我遇到问题,在哪里可以寻求帮助? 你可以访问Open-LLM-VTuber的GitHub仓库,在issue区提交你的问题,或者在相关的开发者社区寻求帮助。开源社区通常非常活跃,你很可能找到答案。

Open-LLM-VTuber官网入口网址

https://github.com/t41372/Open-LLM-VTuber

OpenI小编发现Open-LLM-VTuber网站非常受用户欢迎,请访问Open-LLM-VTuber网址入口试用。

数据评估

本站OpenI提供的Open-LLM-VTuber都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 1月 16日 下午2:29收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。