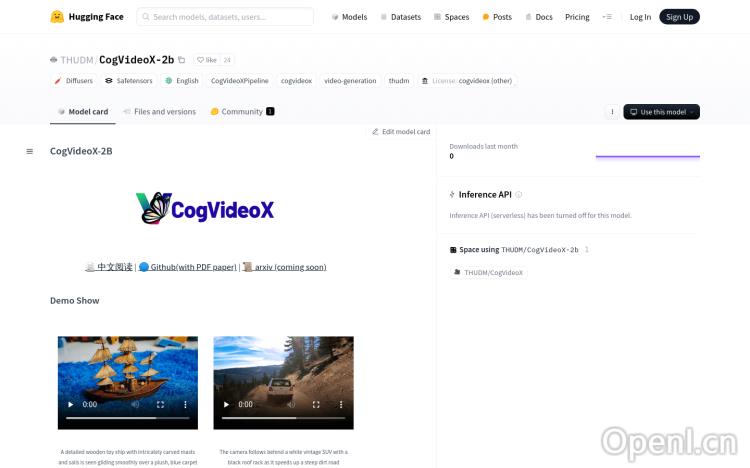

CogVideoX-2B官网

CogVideoX-2B是一个开源的视频生成模型,由清华大学团队开发。它支持使用英语提示语言生成视频,具有36GB的推理GPU内存需求,并且可以生成6秒长、每秒8帧、分辨率为720*480的视频。该模型使用正弦位置嵌入,目前不支持量化推理和多卡推理。它基于Hugging Face的diffusers库进行部署,能够根据文本提示生成视频,具有高度的创造性和应用潜力。

CogVideoX-2B是什么

CogVideoX-2B是由清华大学团队开发的一个开源视频生成模型。它能根据英文提示生成简短的视频,这对于创意工作者来说是一个强大的工具。 它最大的特点是能够将文字描述转化为生动的视频内容,极大地提高了创作效率。

CogVideoX-2B的主要功能

CogVideoX-2B的主要功能是根据英文文本提示生成视频。它可以生成时长6秒,分辨率为720×480,帧率为每秒8帧的视频。虽然功能相对简单,但其生成的视频质量在开源模型中表现出色,具有高度的创造性和应用潜力。

如何使用CogVideoX-2B

使用CogVideoX-2B需要一定的技术基础,因为它需要用户具备一定的编程知识和对深度学习框架的理解。 具体步骤包括安装必要的依赖项(如PyTorch和diffusers库),加载预训练模型,将文本提示编码为模型可理解的嵌入,生成视频帧,最后将帧导出为视频文件。 Hugging Face提供了详细的文档和示例代码,可以帮助用户快速上手。

CogVideoX-2B的产品价格

CogVideoX-2B是一个开源模型,因此它是免费使用的。用户无需支付任何费用即可下载和使用该模型,这对于预算有限的个人或小型团队来说非常具有吸引力。

CogVideoX-2B的常见问题

CogVideoX-2B对硬件的要求高吗?

CogVideoX-2B需要至少36GB的GPU显存才能进行推理,这限制了部分用户的访问。 因此,建议用户拥有高性能的GPU设备。

CogVideoX-2B支持哪些语言?

目前CogVideoX-2B仅支持英文提示。 未来版本可能会支持更多语言。

CogVideoX-2B生成的视频质量如何?

CogVideoX-2B生成的视频质量对于一个开源模型来说已经相当不错,但仍然存在一些局限性,例如分辨率相对较低,视频长度较短,以及偶尔出现一些瑕疵。 随着技术的不断发展,相信未来会有更好的改进。

CogVideoX-2B官网入口网址

https://huggingface.co/THUDM/CogVideoX-2b

OpenI小编发现CogVideoX-2B网站非常受用户欢迎,请访问CogVideoX-2B网址入口试用。

数据评估

本站OpenI提供的CogVideoX-2B都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 1月 16日 下午3:12收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。

粤公网安备 44011502001135号

粤公网安备 44011502001135号