LLaVA++官网

LLaVA++是一个开源项目,旨在通过集成Phi-3和LLaMA-3模型来扩展LLaVA模型的视觉能力。该项目由Mohamed bin Zayed University of AI (MBZUAI)的研究人员开发,通过结合最新的大型语言模型,增强了模型在遵循指令和学术任务导向数据集上的表现。

LLaVA++是什么

LLaVA++是由MBZUAI的研究人员开发的一个开源项目,它通过整合强大的Phi-3和LLaMA-3模型来增强LLaVA模型的视觉理解和语言处理能力。简单来说,它是一个更强大、更智能的视觉语言模型,在指令遵循和学术任务上表现出色。

LLaVA++的主要功能

LLaVA++的主要功能在于提升视觉与语言的交互能力。它能够更好地理解图像和文本之间的关联,并进行更准确的语言理解和生成。具体来说,它可以进行多种任务,例如:图像描述生成、问答、指令遵循等。其整合的Phi-3 Mini Instruct和LLaMA-3 Instruct模型,显著提升了其语言理解能力。

如何使用LLaVA++

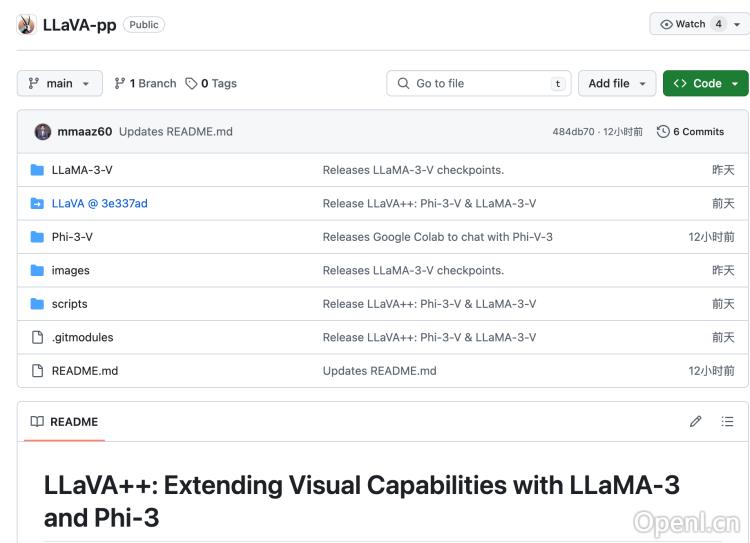

LLaVA++的使用相对便捷。首先,你需要访问其GitHub项目页面(https://github.com/mbzuai-oryx/LLaVA-pp)下载代码库。然后,按照安装指南安装必要的依赖包。接下来,你可以选择使用预训练模型,或根据自己的需求进行模型微调。LLaVA++还提供Google Colab交互式体验,方便用户快速上手。最后,你可以将训练好的模型集成到你的应用中。

LLaVA++的产品价格

作为开源项目,LLaVA++本身是免费的。你只需要支付运行模型所需的计算资源费用,这取决于你使用的硬件和模型大小。

LLaVA++的常见问题

LLaVA++的硬件要求是什么? LLaVA++的硬件需求取决于你选择的模型大小和训练任务的复杂度。较小的模型可以在普通的电脑上运行,而较大的模型则需要更强大的GPU资源。

LLaVA++支持哪些编程语言? LLaVA++主要使用Python进行开发,因此你需要一定的Python编程基础才能有效地使用它。

LLaVA++的训练过程需要多长时间? 训练时间取决于模型大小、数据集规模以及硬件资源。从几小时到几天不等,具体时间需要根据实际情况而定。

LLaVA++官网入口网址

https://github.com/mbzuai-oryx/LLaVA-pp

OpenI小编发现LLaVA++网站非常受用户欢迎,请访问LLaVA++网址入口试用。

数据评估

本站OpenI提供的LLaVA++都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 1月 16日 下午6:47收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。