Sparsh官网

Sparsh是一系列通过自监督算法(如MAE、DINO和JEPA)训练的通用触觉表示。它能够为DIGIT、Gelsight’17和Gelsight Mini生成有用的表示,并在TacBench提出的下游任务中大幅度超越端到端模型,同时能够为新下游任务的数据高效训练提供支持。Sparsh项目包含PyTorch实现、预训练模型和与Sparsh一起发布的数据集。

Sparsh是什么

Sparsh是由Facebook Research团队开发的一套用于视觉触觉传感的自监督学习框架。它利用MAE、DINO和JEPA等先进的自监督算法,学习不同触觉传感器(如DIGIT、Gelsight’17和Gelsight Mini)的通用触觉表示。这意味着Sparsh能够从触觉数据中提取出有意义的特征,并将其应用于各种下游任务,例如机器人抓取、医疗辅助和工业检测等。Sparsh不仅在性能上超越了传统的端到端模型,而且在数据效率方面也表现出色,能够快速适应新的任务。更重要的是,Sparsh项目完全开源,提供了PyTorch实现、预训练模型和数据集,方便研究人员和开发者使用。

Sparsh的主要功能

Sparsh的核心功能在于生成通用的、对多种触觉传感器有效的触觉表示。其主要功能包括:自监督学习算法的应用,支持多种触觉传感器,在TacBench下游任务中表现优异,数据高效训练,提供预训练模型和数据集,支持多种下游任务(如力估计、滑移检测和姿态估计),以及完全开源的代码和模型。

如何使用Sparsh

Sparsh的使用相对简单,主要步骤如下:首先,克隆Sparsh的GitHub仓库到本地;然后,根据提供的environment.yml文件创建并激活conda环境;接着,下载并设置预训练数据集;之后,使用train.py脚本和配置文件训练Sparsh模型;针对特定下游任务,使用train_task.py脚本微调模型;最后,使用test_task.py脚本测试模型性能,并使用demo_forcefield.py进行力场可视化演示。

Sparsh的产品价格

Sparsh是一个开源项目,完全免费。

Sparsh的常见问题

Sparsh支持哪些类型的触觉传感器?

Sparsh目前支持DIGIT、Gelsight’17和Gelsight Mini等多种触觉传感器。

如何评估Sparsh模型的性能?

可以使用test_task.py脚本对训练好的Sparsh模型进行测试,并根据具体的任务评估其性能,例如,在力估计任务中,可以使用均方误差(MSE)等指标来衡量模型的精度。

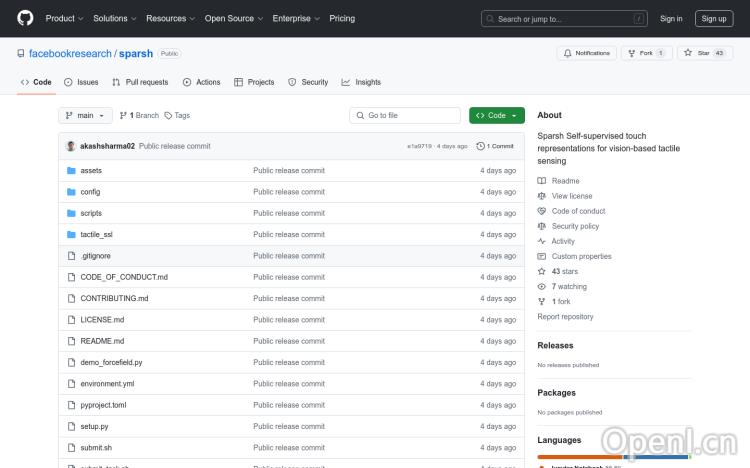

Sparsh的代码和模型在哪里可以获取?

Sparsh的代码和预训练模型都可以在其GitHub仓库(https://github.com/facebookresearch/sparsh)中找到。

Sparsh官网入口网址

https://github.com/facebookresearch/sparsh

OpenI小编发现Sparsh网站非常受用户欢迎,请访问Sparsh网址入口试用。

数据评估

本站OpenI提供的Sparsh都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 1月 16日 下午7:40收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。