SigLIP2官网

SigLIP2 是谷歌开发的多语言视觉语言编码器,具有改进的语义理解、定位和密集特征。它支持零样本图像分类,能够通过文本描述直接对图像进行分类,无需额外训练。该模型在多语言场景下表现出色,适用于多种视觉语言任务。其主要优点包括高效的语言图像对齐能力、支持多种分辨率和动态分辨率调整,以及强大的跨语言泛化能力。SigLIP2 的推出为多语言视觉任务提供了新的解决方案,尤其适合需要快速部署和多语言支持的场景。

SigLIP2是什么?

SigLIP2是由谷歌开发的多语言视觉语言编码器,它能够进行零样本图像分类,这意味着它可以直接根据文本描述对图像进行分类,而无需进行额外的训练。其核心优势在于高效的语言图像对齐能力、多语言支持、动态分辨率调整以及强大的跨语言泛化能力。简单来说,它就像一个能够理解多种语言并识别图像内容的“翻译官”。

SigLIP2的主要功能

SigLIP2的主要功能是多语言零样本图像分类。它可以理解多种语言的文本描述,并以此为依据对图像进行准确分类。此外,它还具备改进的语义理解能力,能够更好地理解图像和文本之间的关联,从而提升分类精度。动态分辨率调整功能则使其能够适应不同尺寸的图像,提高了模型的适用性。

如何使用SigLIP2?

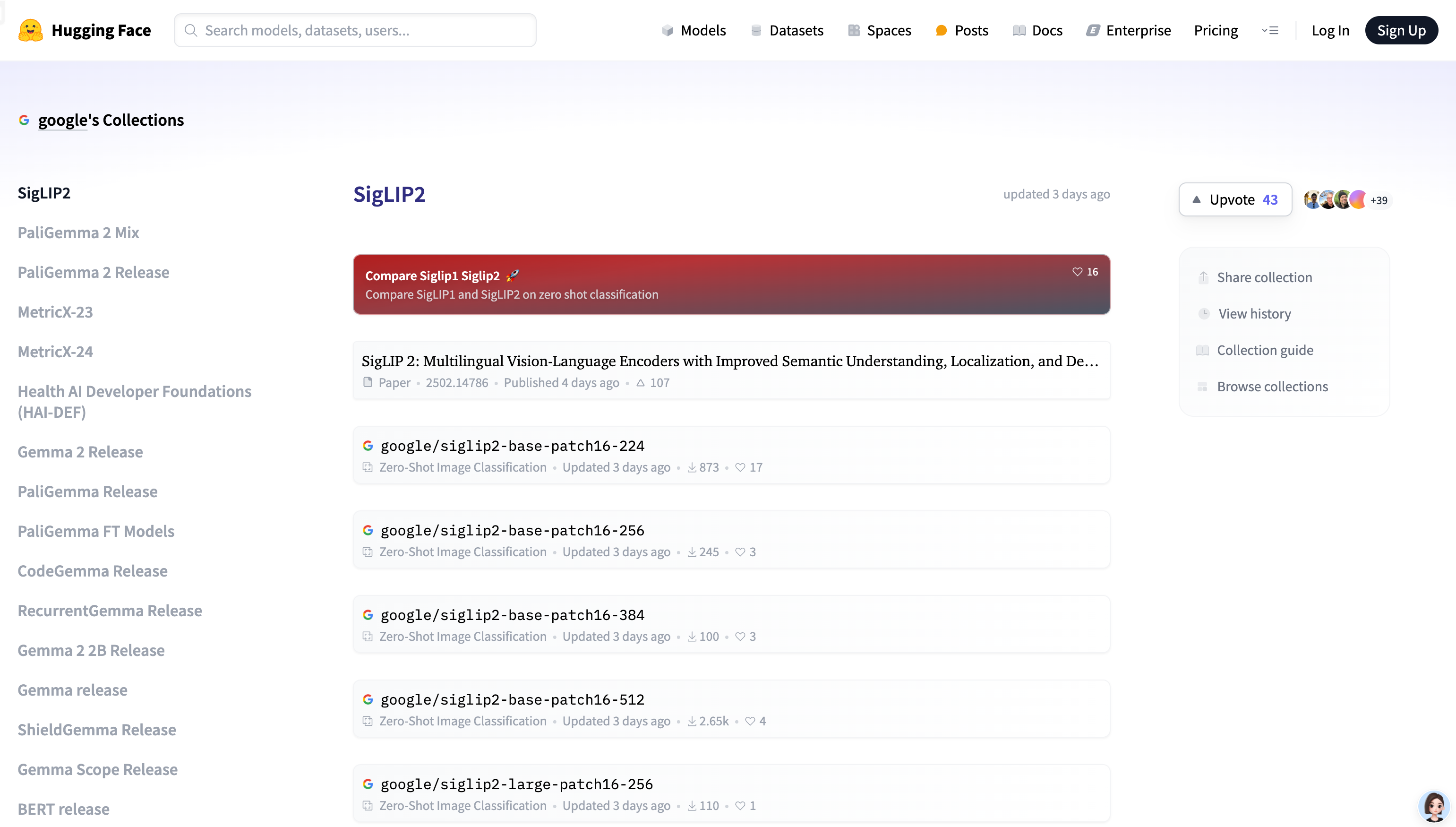

使用SigLIP2非常便捷。首先,访问Hugging Face网站,找到SigLIP2模型页面。然后,根据你的需求选择合适的模型变体(不同分辨率或优化版本)。接下来,下载模型文件或使用Hugging Face提供的API接口。准备好图像数据和对应的文本描述后,即可使用模型进行零样本图像分类,最终获得分类结果。整个过程简单易懂,即使没有编程基础的用户也能轻松上手。

SigLIP2的价格

文中未提及SigLIP2的价格信息,推测其为开源或免费提供。

SigLIP2常见问题

SigLIP2支持哪些语言? SigLIP2支持多种语言,具体支持哪些语言,需要查看Hugging Face上的官方文档。

SigLIP2的准确率如何? SigLIP2的准确率取决于所使用的模型变体、图像质量和文本描述的质量。一般来说,其准确率较高,但并非完美无缺。

SigLIP2的运行速度如何? SigLIP2的运行速度取决于所使用的硬件和模型大小。较大的模型运行速度相对较慢,反之亦然。建议根据实际需求选择合适的模型变体。

SigLIP2官网入口网址

https://huggingface.co/collections/google/siglip2-67b5dcef38c175486e240107

OpenI小编发现SigLIP2网站非常受用户欢迎,请访问SigLIP2网址入口试用。

数据评估

本站OpenI提供的SigLIP2都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 3月 17日 下午8:23收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。