Llama 3.1 Nemotron Ultra 253B官网

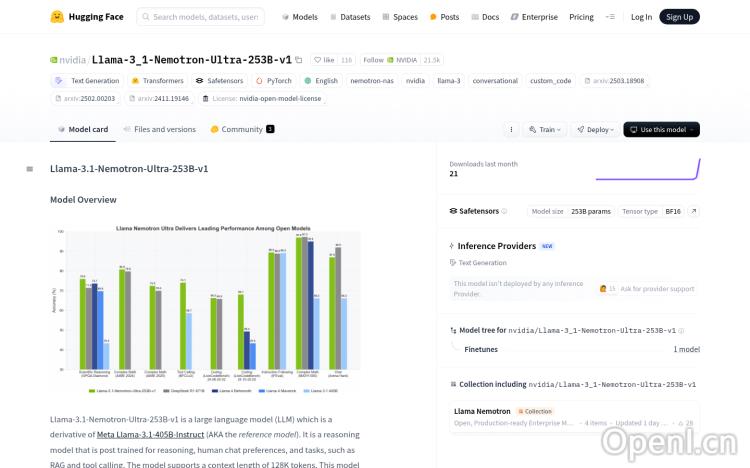

Llama-3.1-Nemotron-Ultra-253B-v1 是一个基于 Llama-3.1-405B-Instruct 的大型语言模型,经过多阶段的后训练以提升推理和能力。该模型支持高达 128K 的上下文长度,具备较好的准确性和效率平衡,适用于商业用途,旨在为开发者提供强大的 AI 助手功能。

Llama 3.1 Nemotron Ultra 253B是什么

Llama 3.1 Nemotron Ultra 253B-v1 是由NVIDIA基于Llama-3.1-405B-Instruct进行多阶段后训练的大型语言模型。它拥有高达128K的上下文长度,在准确性和效率方面取得了良好的平衡,并支持商业用途。这款模型旨在成为开发者强大的AI助手,提供高效的推理和功能。它支持多种语言,包括英语、德语、法语等。

Llama 3.1 Nemotron Ultra 253B主要功能

Llama 3.1 Nemotron Ultra 253B的主要功能包括:高效推理、多语言支持、大上下文处理能力(高达128K)、广泛的适用性(AI代理系统、机器人、RAG系统等)、强大的指令跟随能力以及良好的硬件兼容性(NVIDIA Hopper和Ampere微架构)。它可以用于构建智能客服系统、教育辅助工具、内容创作辅助工具等。

如何使用Llama 3.1 Nemotron Ultra 253B

使用该模型需要以下步骤:1. 访问Hugging Face上的模型页面并下载相关文件;2. 安装必要的依赖库,例如transformers;3. 加载模型并配置推理参数,例如温度和最大输出长度;4. 输入需要处理的文本,并调用模型进行推理;5. 获取模型输出,并根据需求进行后处理。

Llama 3.1 Nemotron Ultra 253B产品价格

本文未提供Llama 3.1 Nemotron Ultra 253B的价格信息。建议访问NVIDIA官网或Hugging Face模型页面获取相关信息。

Llama 3.1 Nemotron Ultra 253B常见问题

该模型的推理速度如何?与其他类似模型相比有什么优势? 该模型通过改进的神经架构搜索,实现了更快的推理速度。具体速度取决于硬件配置和任务复杂度,但总体而言,其效率在同类模型中具有竞争力。

模型支持哪些编程语言? 虽然没有明确列出所有支持的编程语言,但其强大的多语言支持能力暗示其可能理解和生成多种编程语言的代码。实际支持情况需要通过测试验证。

128K的上下文长度在实际应用中如何体现? 128K的上下文长度允许模型处理更长的输入文本,例如,可以一次性处理整本书的内容,或者更长的对话历史,从而提高处理复杂任务和长篇内容的准确性和连贯性。

Llama 3.1 Nemotron Ultra 253B官网入口网址

https://huggingface.co/nvidia/Llama-3_1-Nemotron-Ultra-253B-v1

OpenI小编发现Llama 3.1 Nemotron Ultra 253B网站非常受用户欢迎,请访问Llama 3.1 Nemotron Ultra 253B网址入口试用。

数据评估

本站OpenI提供的Llama 3.1 Nemotron Ultra 253B都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 4月 9日 下午5:45收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。