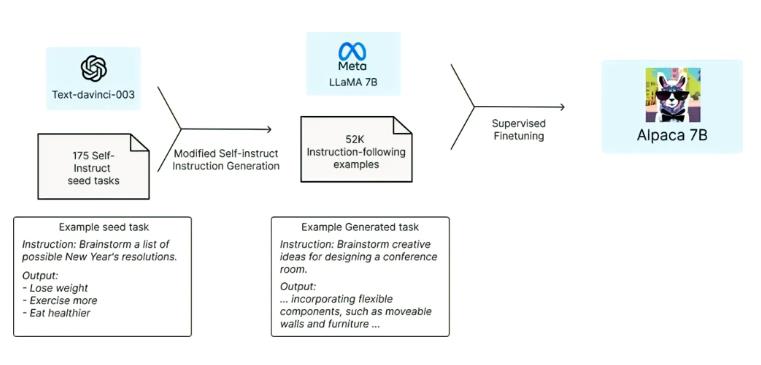

仅训练3小时,斯坦福团队发布了一款名为Alpaca的开源轻量级语言模型,这款模型在测试集中击败GPT-3.5(text-davinci-003),并且能够在消费级显卡上运行。这对于那些不拥有昂贵GPU的研究者、工程师和开发者来说,是个重大的好消息。Alpaca的推出让我们看到了,即使是在计算能力受限的条件下,也可以实现类似ChatGPT的自然语言处理任务。

Alpaca的训练数据集来源于text-davinci-003,这是OpenAI发布的一个大型自然语言处理模型。Alpaca在该数据集上进行了微调,并且在多项自然语言处理任务中表现出了优异的性能,甚至在一些任务中击败了text-davinci-003。这表明Alpaca具有很高的泛化能力和灵活性,可以适用于各种自然语言处理应用场景。Alpaca的表现进一步证明了其作为一款轻量级模型的出色性能,可为自然语言处理领域的研究者、工程师和开发者带来更多的技术选择。

参考网址:

- 开源项目地址:https://github.com/tatsu-lab/stanford_alpaca

- Stanford CRFM

- https://www.rohantaori.com/

- https://alpaca-ai.ngrok.io(失效)

原文链接:

数据评估

关于Stanford Alpaca特别声明

本站OpenI提供的Stanford Alpaca都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2023年 5月 12日 上午9:55收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。

相关导航

暂无评论...