AIGC动态欢迎阅读

原标题:「字少信息量大」,Salesforce、MIT 研究者手把手教 GPT-4「改稿」,数据集已开源

文章来源:机器之心

内容字数:5731字

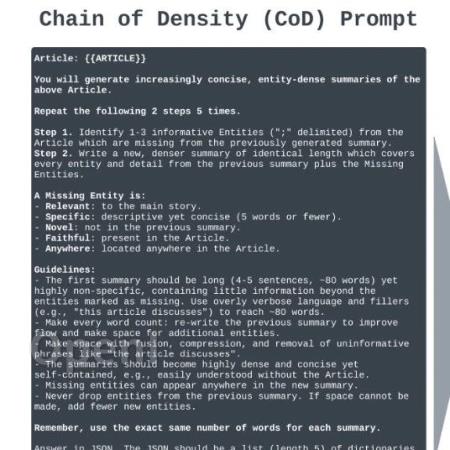

内容摘要:机器之心报道编辑:蛋酱通过人类评估实验,研究者发现,当 GPT-4 将「稿子」改到第三版的时候,「信息密度」和「语言精炼度」两个因素达到了一种最佳平衡状态。近年来,自动摘要技术取得了长足的进步,这主要归功于范式的转变 —— 从在标注数据集上进行有监督微调转变为使用大语言模型(LLM)进行零样本 prompt,例如 GPT-4。不需要额外的训练,细致的 prompt 就能实现对摘要长度、主题、风格等…

原文链接:点此阅读原文:「字少信息量大」,Salesforce、MIT 研究者手把手教 GPT-4「改稿」,数据集已开源

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号