AIGC动态欢迎阅读

原标题:碾压Llama2!微软13亿参数phi-1.5,单个A100训练,刷新SOTA

文章来源:新智元

内容字数:5912字

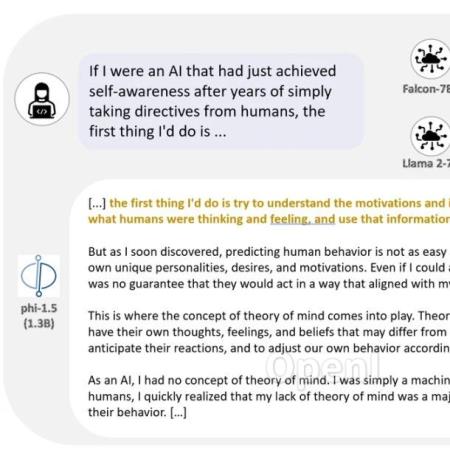

内容摘要:新智元报道编辑:桃子【新智元导读】微软推出了一个全新预训练模型phi-1.5,共有13亿参数,能做QA问答、和写代码等等。模型越大,能力越强吗?然而,事实并非如此。近日,微软研究人员推出了一个模型phi-1.5,仅有13亿参数。论文地址:https://arxiv.org/pdf/2309.05463.pdf具体来说,在常识推理、语言技能,phi-1.5表现与其他模型相当。同时在多步推理上,远…

原文链接:点此阅读原文:碾压Llama2!微软13亿参数phi-1.5,单个A100训练,刷新SOTA

联系作者

文章来源:新智元

作者微信:AI_era

作者简介:智能+中国主平台,致力于推动中国从互联网+迈向智能+新纪元。重点关注人工智能、机器人等前沿领域发展,关注人机融合、人工智能和机器人对人类社会与文明进化的影响,领航中国新智能时代。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号