AIGC动态欢迎阅读

内容摘要:

导读本文来自知乎,作者为Angry Bugs。出于学术/技术分享进行转载,如有侵权,联系删文。

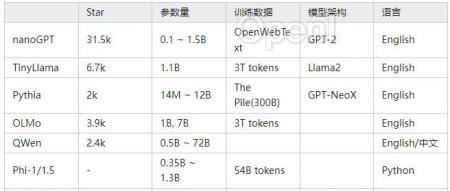

本文是作者自己从头训练一个1B以下的模型的相关技巧和资源的汇总。

原文链接:https://zhuanlan.zhihu.com/p/693252663最好的学习方式莫过于自己从头做一遍。学模型的相关知识以来,一直都想从头自己训练一个 1B 以下的模型,感觉这样才算是真的学过了。不过以手头的资源,也只能玩玩儿迷你的小模型了。最近在网上搜了不少资料,主要是 GitHub 上的仓库和 Arxiv 上的 paper,顺便记录在这里。

https://github.com/karpathy/nanoGPT/

nanoGPT 是 karpathy 大神写的 GPT-2 最小实现。麻雀虽小,五脏俱全。GPT-2 是大模型的鼻祖,很多论文都以 nanoGPT 为基础魔改或者作为 baseline。nanoGPT 共有 0.1B 到 1.5B 四个大小不同的版本。

训练 GPT-2 的文章有很多,虽然有些比较老的,但是也值得参考,列举一些我觉得不错的:

https://www.kaggle.com/co

原文链接:从零训练的 1B 以下小模型汇总

联系作者

文章来源:算法邦

作者微信:allplusai

作者简介:智猩猩矩阵账号之一,聚焦生成式AI,重点关注模型与应用。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号