AIGC动态欢迎阅读

原标题:3天把Llama训成Mamba,性能不降,推理更快!

关键字:模型,算法,研究人员,草稿,参数

文章来源:新智元

内容字数:0字

内容摘要:

新智元报道编辑:alan

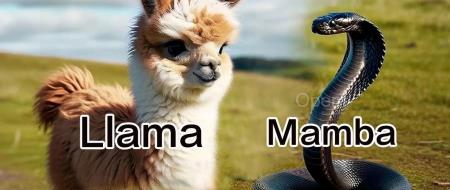

【新智元导读】近日,Mamba方面又搞出了有意思的研究:来自康奈尔、普林斯顿等机构的研究人员成功将Llama提炼成了Mamba模型,并且设计了新的推测解码算法,加速了模型的推理。先来看一张其乐融融的图片(一眼AI):

右边的小羊驼代表Llama,而左边的蛇(Mamba)也是我们的老熟人了。

至于到底能不能其乐融融,咱就不管了,之所以有此场景,是因为Mamba方面又搞出了有意思的研究:

——如何把Llama变成Mamba?

论文地址:https://arxiv.org/pdf/2408.15237

代码地址:https://github.com/jxiw/MambaInLlama

近日,来自康奈尔、普林斯顿等机构的研究人员推出了上面这篇工作,将Llama这样的大型Transformer提炼成了Mamba模型,

并且成功在Mamba架构上应用了带有硬件感知的推测解码算法,提高了整个模型的推理速度。

为什么要把Llama变成Mamba?

因为从头开始训练一个大模型太贵了。

Mamba也火了这么长时间了,相关的研究每天都有,但自己训练大尺寸Mamba模型的却很少。

原文链接:3天把Llama训成Mamba,性能不降,推理更快!

联系作者

文章来源:新智元

作者微信:

作者简介:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...