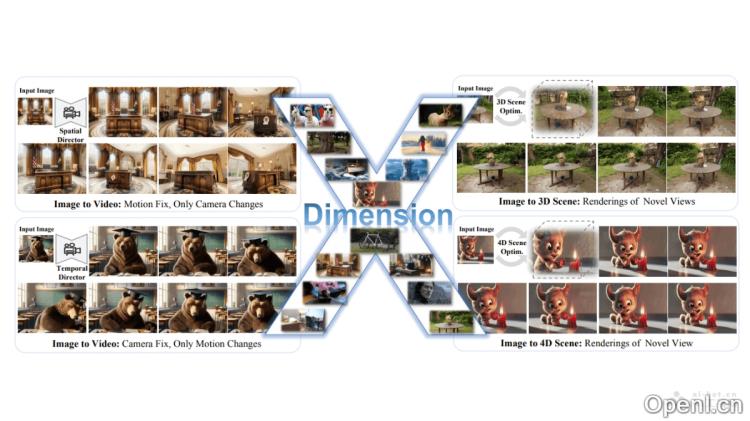

DimensionX是一个由香港科技大学、清华大学和生数科技联合研发的先进框架,能够通过单张图片生成高质量的3D和4D场景。借助视频扩散技术,该框架实现了对空间和时间维度的精确控制。其特色在于基于ST-Director技术解耦空间和时间因素,支持或组合控制,从而创造出动态变化的复杂场景。

DimensionX是什么

DimensionX是一个前沿框架,由香港科技大学、清华大学和生数科技共同开发,致力于从单张图片生成高度逼真的3D和4D场景。该框架利用视频扩散技术,能够精确控制空间和时间维度。通过ST-Director技术,DimensionX实现了空间与时间因素的解耦,支持或组合的控制方式,生成具有动态变化的复杂场景。此外,DimensionX还采用了轨迹感知机制和身份保持去噪策略,以增强场景的一致性与真实感。

DimensionX的主要功能

- 3D场景生成:能够从单张图片生成新的视角渲染,从而构建出三维场景。

- 4D场景生成:通过单张图片生成包含时间和空间变化的动态场景。

- 视频扩散控制:基于ST-Director技术,实现对视频扩散过程中空间和时间因素的精准解耦和控制。

- 轨迹感知机制:专为3D生成设计,以应对复杂的现实世界场景和相机。

- 身份保持去噪策略:专为4D生成设计,提升场景一致性,尤其是在动态对象与背景之间。

DimensionX的技术原理

- ST-Director(空间和时间导演):

- 维度感知LoRAs:通过学习维度变化数据获得的低秩适应(LoRAs),实现视频扩散中空间和时间因素的解耦。

- S-Director(空间导演):负责生成与空间变化相关的视频帧,控制相机的视角和位置。

- T-Director(时间导演):负责生成与时间变化相关的视频帧,控制场景中对象的动态。

- 维度感知分解:定义空间和时间的等价关系,构建S-Quotient Space与T-Quotient Space,分别捕捉视频中的空间轨迹和时间轨迹。

- 无需训练的维度感知组合:基于视频扩散过程中的去噪机制,开发出无需训练的方法,实现混合维度控制,能够在去噪过程的不同阶段切换S-Director与T-Director,生成包含空间和时间变化的视频。

- 3D场景生成:

- 轨迹感知机制:针对不同的相机轨迹训练多个S-Director,以覆盖广泛的相机模式。

- 视频插值模型:生成高质量的插值视频,平滑而一致地过渡稀疏视图。

- 4D场景生成:

- 参考视频latent共享:基于选择的参考帧并共享其latent代码,以增强所有空间变体视频之间的一致性。

- 外观细化:对每个视点的动态视频进行细化,增强多视图视频间的稳定性与一致性。

DimensionX的项目地址

- 项目官网:chenshuo20.github.io/DimensionX

- GitHub仓库:https://github.com/wenqsun/DimensionX

- arXiv技术论文:https://arxiv.org/pdf/2411.04928

DimensionX的应用场景

- 电影与娱乐行业:生成特效场景,降低拍摄成本,创造虚拟背景。

- 游戏开发:生成真实感十足的游戏环境,快速进行原型设计。

- 虚拟现实(VR)与增强现实(AR):构建动态三维环境,提升用户体验。

- 建筑与城市规划:根据设计图生成建筑模型,模拟城市发展。

- 教育与培训:创建历史场景可视化,模拟紧急情况以供学习。

常见问题

- DimensionX能生成哪些类型的场景? DimensionX可以生成高质量的3D和4D动态场景,适用于多种行业。

- 如何访问DimensionX的技术文档? 您可以通过项目官网或GitHub仓库访问技术文档和相关资料。

- DimensionX适合哪些使用场景? DimensionX适用于电影制作、游戏开发、虚拟现实、建筑设计等多个领域,具有广泛的应用前景。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号