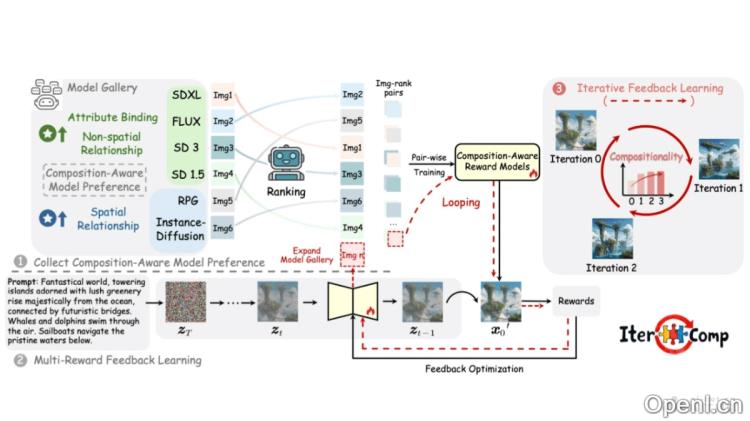

IterComp是一个由清华大学、北京大学、LibAI Lab、中国科学技术大学、牛津大学和普林斯顿大学的研究者们共同开发的文本到图像生成框架。它基于迭代反馈学习机制,融合多种扩散模型的生成偏好,显著增强了模型在处理复杂组合任务时的综合能力。通过构建一个包含多个开源模型的图库,IterComp能够在属性绑定、空间关系及非空间关系等方面展现出各自的优势,从而全面提升生成图像的质量和准确性。

XX是什么

IterComp是一个先进的文本到图像生成框架,旨在通过迭代反馈学习机制整合多个扩散模型的生成优势。这一框架不仅优化了基础扩散模型的组合生成能力,还确保在复杂语义对齐和多类别对象组合方面的卓越表现,同时未增加额外的计算负担。

主要功能

- 模型偏好聚合:IterComp整合多种开源扩散模型的生成偏好,在不同的组合生成任务中发挥各自的长处。

- 数据集构建:依据模型偏好,构建一个包含大量图像排名对的数据集,以训练组合感知的奖励模型。

- 迭代反馈学习:通过迭代反馈学习方法,逐步优化基础扩散模型和奖励模型,提升模型在复杂组合任务中的表现。

- 自我优化:IterComp具备闭环自我优化能力,通过多次迭代不断提高生成图像的质量与准确性。

产品官网

- GitHub仓库:https://github.com/YangLing0818/IterComp

- HuggingFace模型库:https://huggingface.co/comin/IterComp

- arXiv技术论文:https://arxiv.org/pdf/2410.07171

应用场景

- 艺术创作:艺术家和设计师可以利用IterComp生成具有特定风格和复杂组合元素的艺术作品,如奇幻场景、角色设计或概念画。

- 游戏开发:在游戏设计中,IterComp能够快速生成游戏环境、角色和道具的原型图像,助力游戏资产的快速创建。

- 广告和品牌营销:营销人员通过IterComp设计广告图像,能够根据文本描述精确组合多个元素,吸引目标受众的注意。

- 教育和培训:在教育领域,IterComp可用于创建教学材料中的插图,如科学概念的视觉解释或历史的再现。

- 媒体和娱乐:内容创作者利用IterComp生成视频游戏、电影或电视剧的概念艺术,为故事叙述增添视觉元素。

常见问题

- IterComp的使用难度如何?:IterComp设计为用户友好,提供详细的文档和示例,便于用户上手。

- 生成结果的质量如何?:通过迭代反馈学习和多模型聚合,IterComp在生成图像的质量和准确性方面表现优异。

- 是否支持多语言输入?:IterComp支持多种语言的文本描述,用户可以用自己熟悉的语言生成图像。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...