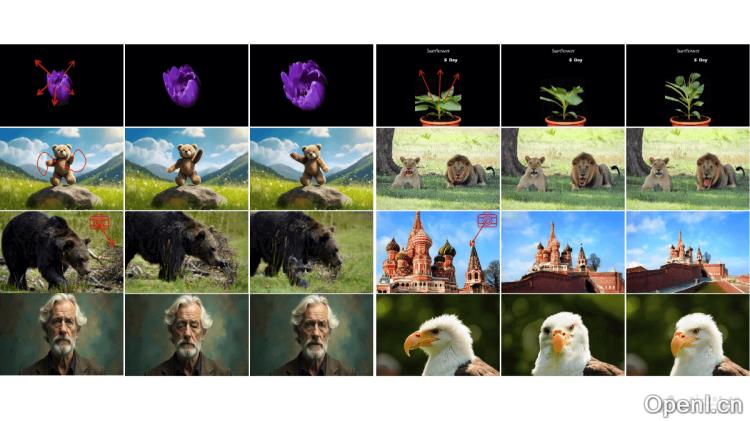

AnimateAnything是一项由浙江大学和北京航空航天大学的研究者们开发的前沿视频生成技术。该技术实现了对视频内容的精准控制,包括相机、文本提示和用户动作注释等多种方式。通过多尺度控制特征融合网络,AnimateAnything能够将控制信息转化为逐帧光流,以指导视频的生成过程。此外,为了减少大范围所引发的视频闪烁,AnimateAnything还引入了基于频率的稳定模块,进一步提升了视频的稳定性和连贯性。

AnimateAnything是什么

AnimateAnything是一种统一可控的视频生成技术,由浙江大学和北京航空航天大学的研究团队推出。该技术允许用户精确操作视频内容,涵盖相机轨迹、文本提示以及用户的动作注释等多种控制方式。AnimateAnything基于多尺度控制特征融合网络,将控制信息转化为逐帧光流,从而指导视频生成。为了减少因大范围造成的闪烁现象,AnimateAnything还提出了基于频率的稳定模块。

AnimateAnything的主要功能

- 精准视频控制:用户可以在多种条件下对视频进行精确操控,包括相机轨迹、文本提示和用户的动作注释。

- 多元控制信号整合:支持将不同的控制信号(如物体和相机移动)统一转化为光流表示,简化了多信号处理的复杂性。

- 光流引导生成:利用光流作为先验,确保视频生成过程的连贯性与一致性。

- 减少闪烁问题:通过基于频率的稳定模块,显著降低大范围引起的闪烁现象,从而增强视频的时间一致性。

AnimateAnything的技术原理

- 多尺度控制特征融合网络:该网络能够处理多种控制信号,将其统一转换为逐帧光流,涵盖显式控制信号(如基于箭头的注释)和隐式控制信号(如相机轨迹)。

- 光流作为先验:生成的光流被作为先验,以指导视频生成模型的行为,从而实现对视频生成过程的精准控制。

- 基于频率的稳定模块:通过在频域内修改特征以增强时间一致性,减少因大范围引起的视频闪烁和不稳定性。

- 两阶段视频生成流程:

- 第一阶段:将各种视觉控制信号转换为统一的光流表示。

- 第二阶段:使用生成的统一光流来指导最终视频的生成,确保视频与参考图像及注释的语义一致。

- 频域特征修改:通过快速傅里叶变换(FFT)和逆傅里叶变换(InvFFT)在频域中修改特征,以保持视频生成过程中的特征一致性。

AnimateAnything的项目地址

- 项目官网:Animate_Anything

- GitHub仓库:https://github.com/yu-shaonian/AnimateAnything

- arXiv技术论文:https://arxiv.org/pdf/2411.10836

AnimateAnything的应用场景

- 电影与视频制作:在电影制作过程中,AnimateAnything可以用于生成或修改视频片段,例如动画角色的动作捕捉、特效制作及场景模拟,从而提高制作效率并降低成本。

- 虚拟现实(VR)与增强现实(AR):在VR和AR应用中,AnimateAnything能够创造更加真实和动态的虚拟环境,提供自然且流畅的交互体验。

- 游戏开发:游戏开发者可以利用AnimateAnything生成或控制游戏角色及环境的动画,进而提升游戏的沉浸感和可玩性。

- 模拟与训练:在军事、航空和医疗等领域的模拟训练中,生成逼真的视频内容可用于模拟各种复杂场景,从而提升训练效果。

- 教育与培训:通过AnimateAnything制作教育视频和培训材料,使学习内容更加生动易懂。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号