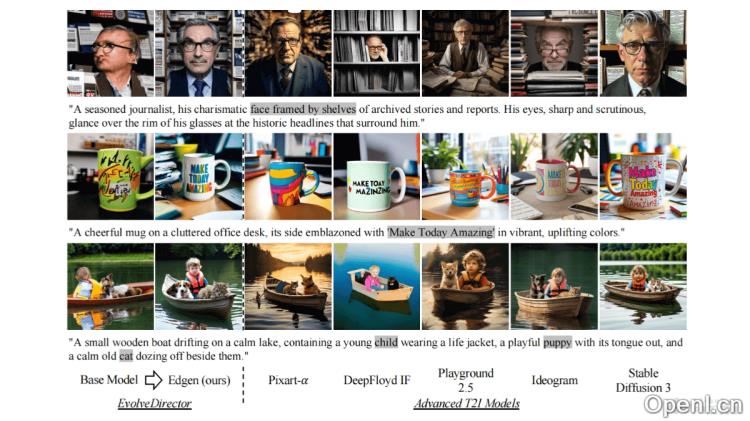

EvolveDirector是一个由阿里巴巴与南洋理工大学共同开发的创新性框架,旨在利用开放资源和先进模型的API接口,训练出性能卓越的文本到图像生成模型。该框架通过与现有高级模型的API交互,获取数据对并训练基础模型,同时借助预训练的大型视觉语言模型(VLMs)动态优化训练数据集,从而显著降低所需数据量和训练成本。最终,训练出的模型Edgen在多个方面超越了现有的高级模型,能够生成更加优质的图像。

EvolveDirector是什么

EvolveDirector是一个前沿框架,由阿里巴巴与南洋理工大学携手推出,旨在通过公开资源和高级模型的API接口,训练出高效的文本到图像生成模型。该框架通过与高级模型的API交互来获取文本-图像对,训练基础模型,同时利用预训练的大型视觉语言模型(VLMs)动态优化训练数据集,从而显著减少所需的数据量和训练开销。EvolveDirector可以从多个高级模型中筛选出最佳样本进行学习,使得最终训练出的模型Edgen在多个方面超越现有的高级模型。

EvolveDirector的主要功能

- 文本到图像生成:将文本描述转化为高质量的图像。

- API交互:通过与先进文本到图像模型的API交互,获取文本-图像数据对以训练基础模型。

- 数据集优化:利用预训练的大型视觉语言模型(VLMs)动态调整训练数据集,进行智能选择、扩展、删除和变异操作。

- 模型进化:指导基础模型的演化,模拟并超越高级模型的生成能力。

- 多模型学习:从多个高级模型中挑选最佳样本进行学习,提升生成图像的质量与多样性。

- 在线训练:基于在线训练策略,使基础模型能够持续不断地进行训练,并动态更新训练数据集。

EvolveDirector的技术原理

- API数据获取:通过与高级模型的公共API交互,获取大量的文本-图像数据对。

- VLM评估与指导:利用预训练的VLMs对生成的图像进行评估,选择与文本描述最为匹配的图像,以指导数据集的构建。

- 动态数据集维护:在训练过程中,VLM将持续评估基础模型的性能,并根据评估结果动态更新训练数据集。

- 智能选择:VLM会选择与文本提示最契合的图像,保留高质量数据,删除低质量或冗余数据。

EvolveDirector的项目地址

- GitHub仓库:https://github.com/showlab/EvolveDirector

- HuggingFace模型库:https://huggingface.co/ruizhaocv/Edgen

- arXiv技术论文:https://arxiv.org/pdf/2410.07133

EvolveDirector的应用场景

- 内容创作:艺术家和设计师可以借助该工具生成插图、概念艺术作品或设计原型,显著加快创作流程。

- 媒体和娱乐:在电影和游戏行业,EvolveDirector可用于创建逼真的背景、场景和角色,减少传统绘图和建模的工作量。

- 广告和营销:快速生成广告图像和营销材料,根据文本描述迅速制作吸引人的视觉内容。

- 社交媒体:用户可以根据自身想法生成个性化的图像内容,以提升社交媒体上的个人表达。

- 教育和研究:在教育领域,EvolveDirector帮助学生和研究人员可视化复杂的概念与理论。

常见问题

- EvolveDirector适合哪些用户?:适合艺术家、设计师、开发者以及任何希望利用文本生成图像的人。

- 如何开始使用EvolveDirector?:用户可以访问其GitHub仓库,按照说明进行安装和使用。

- EvolveDirector支持哪些语言?:框架支持多种语言的文本描述,用户可以根据需要进行设置。

- 是否需要编程技能?:虽然拥有编程背景会有帮助,但框架的设计旨在尽量降低使用门槛。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...