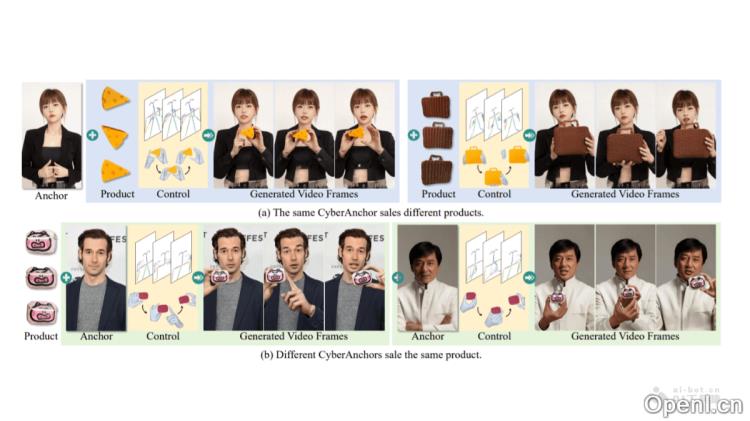

AnchorCrafter是一款基于扩散模型的智能视频制作系统,专为自动生成高保真度的主播风格产品推广视频而设计。该系统通过整合人-物交互(HOI)与姿态引导的人体视频生成技术,能够高度还原物体的外观与,并有效管理复杂的人物与物体之间的互动。

AnchorCrafter是什么

AnchorCrafter是一个创新的智能视频制作软件,致力于自动生成具有主播风格的高质量产品推广视频。该系统利用整合人-物交互(HOI)技术,结合姿态引导的人体视频生成,确保对物体外观和的精准还原,并管理复杂的人物与物体交互。通过采用HOI-外观感知和HOI-注入技术,以及HOI区域重加权损失训练目标,AnchorCrafter能够在细节上进行深度学习,确保视频生成过程中的人物形象和动作的一致性。相较于传统方法,AnchorCrafter在物体外观保持、交互感知及视频质量上表现出色,为在线广告和消费者互动提供了全新的可能性。

AnchorCrafter的主要功能

- 高质量视频生成:自动创建高保真度的主播风格产品推广视频。

- 人-物交互(HOI)集成:将人物与物体的交互自然地融入视频中,提升视频的真实感和互动性。

- 外观保持:在视频中保持物体的外观细节,确保从多视角观察时物体的外观准确无误。

- 控制:精确控制物体的轨迹,与人物动作协调一致。

- 互遮挡管理:处理人物与物体交互时的遮挡问题,保持视频的连贯性和自然性。

- 细节增强学习:基于HOI区域重加权损失在训练过程中增强对物体细节的学习。

AnchorCrafter的技术原理

- 视频扩散模型:基于扩散模型架构,利用扩散UNet和变分自编码器(VAE)处理视频帧,将视频序列编码到潜在空间,从噪声中重建高质量的视频帧。

- HOI-外观感知(HOI-appearance perception):

- 多视角特征融合:通过多个视角下的物体参考图像提取物体外观特征,增强模型对物体形状和纹理的识别能力。

- 人-物双适配器:在替换UNet中的交叉注意力层,实现人物与物体特征的更好分离,避免外观混淆。

- HOI-注入(HOI-motion injection):

- 物体轨迹控制:利用深度图作为输入,通过轻量级卷积网络处理深度信息,控制视频中物体的轨迹。

- 互遮挡处理:结合3D手部网格输入,处理人物手部与物体交互时的遮挡问题,确保交互的自然性和准确性。

- HOI区域重加权损失(HOI-region reweighting loss):在训练过程中,增加手部-物体交互区域的权重,让模型更加关注这些区域,提高物体细节的学习和生成质量。

AnchorCrafter的项目地址

- 项目官网:cangcz.github.io/Anchor-Crafter

- GitHub仓库:https://github.com/cangcz/AnchorCrafter(即将开放)

- arXiv技术论文:https://arxiv.org/pdf/2411.17383

AnchorCrafter的应用场景

- 在线购物平台:自动生成产品介绍视频,提升商品页面的吸引力和用户购买意愿。

- 社交媒体营销:为品牌和个人创作者提供工具,制作吸引人的产品推广内容,增加粉丝互动和品牌曝光。

- 电视广告制作:快速制作高质量的电视广告,减少传统拍摄成本和时间。

- 虚拟直播带货:在直播中使用虚拟主播展示和推广产品,提高直播效率和观众体验。

- 教育培训:制作教学视频,模拟实际操作过程,如烹饪、手工制作等,增强学习效果。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...