原标题:视频一键拆分PS层!DeepMind新模型效果碾压同级,物体、背景完美分离,还能脑补

文章来源:新智元

内容字数:5060字

引言

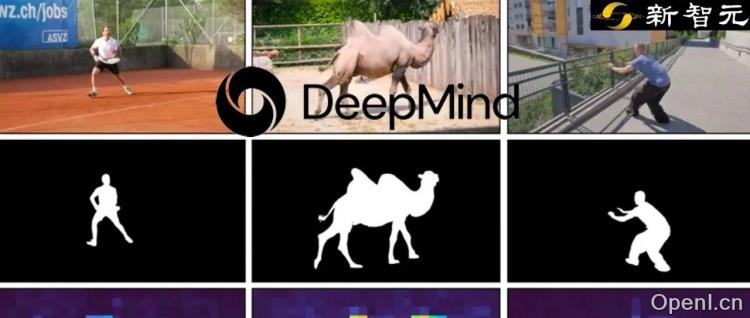

DeepMind的研究团队与其他机构合作,提出了一种创新的视频分层方法,旨在提升视频编辑的灵活性和效率。该方法无需假设背景静止或依赖精确的相机姿态,能够将复杂的视频内容分解为多个层次,从而有效地处理动态场景中的物体及其效果。

技术背景

传统的视频处理方法在处理动态背景和复杂场景时存在局限,通常需要静态背景或精确的相机和深度信息。新提出的框架通过训练视频扩散模型,克服了这些限制,能够自动生成清晰的图像层,并补全被遮挡的动态区域。

核心方法

研究人员的框架利用生成式先验知识,分析物体与视频效果的联系。通过微调预训练模型,使用小型的分层视频数据集,能够处理具有软阴影、光泽反射等效果的日常视频。

模型架构

基础模型Lumiere生成80帧视频,并通过超分辨率技术提升分辨率。Casper模型在此基础上进行微调,引入三元掩码以区分需要移除和保留的区域,并处理阴影和效果的移除。

数据构建与训练

训练数据集由真实和合成视频组成,涵盖多种场景和对象。研究者通过多种来源生成数据,确保模型对复杂场景的适应能力。

实验与结果

在实验中,研究人员对新方法进行了定性和定量分析,结果显示该方法在背景层重建和物体移除方面优于现有技术。通过评估,文中提出的方法在多个指标上表现出色,证明了其有效性。

结论

该研究展示了新的视频分层方法在处理动态背景和复杂效果方面的潜力,能够显著提升视频编辑的效率和质量。未来,这一技术有望在更广泛的应用场景中发挥作用,推动视频处理领域的进一步发展。

联系作者

文章来源:新智元

作者微信:

作者简介:智能+中国主平台,致力于推动中国从互联网+迈向智能+新纪元。重点关注人工智能、机器人等前沿领域发展,关注人机融合、人工智能和机器人对人类社会与文明进化的影响,领航中国新智能时代。

粤公网安备 44011502001135号

粤公网安备 44011502001135号